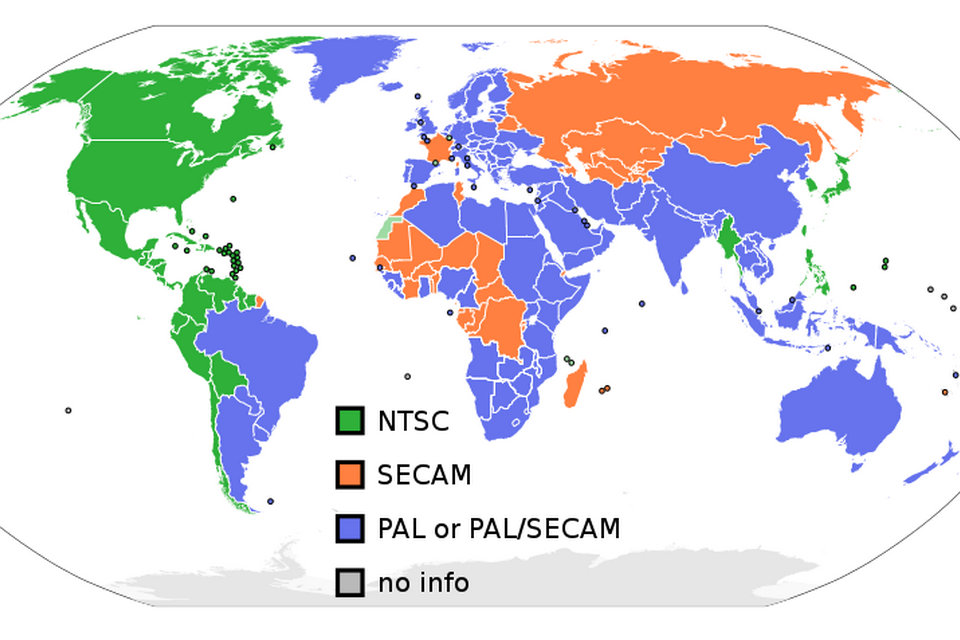

O NTSC, nomeado em homenagem ao Comitê do Sistema Nacional de Televisão, é o sistema de televisão analógica utilizado na América do Norte e até a conversão digital na maioria das Américas (exceto Brasil, Argentina, Paraguai, Uruguai e Guiana Francesa); Myanmar; Coreia do Sul; Taiwan; Filipinas, Japão; e algumas nações e territórios das ilhas do Pacífico.

O primeiro padrão NTSC foi desenvolvido em 1941 e não tinha previsão de cor. Em 1953, adotou-se um segundo padrão NTSC, que permitia a transmissão de televisão a cores compatível com o estoque existente de receptores em preto e branco. O NTSC foi o primeiro sistema de cores de transmissão amplamente adotado e permaneceu dominante até os anos 2000, quando começou a ser substituído por diferentes padrões digitais, como o ATSC e outros.

A maioria dos países que usam o padrão NTSC, bem como aqueles que usam outros padrões de televisão analógica, mudaram para, ou estão em processo de mudar para os padrões mais recentes de televisão digital, havendo pelo menos quatro padrões diferentes em uso em todo o mundo. América do Norte, partes da América Central e Coréia do Sul estão adotando ou adotaram os padrões do ATSC, enquanto outros países (como o Japão) estão adotando ou adotaram outros padrões em vez do ATSC. Após quase 70 anos, a maioria das transmissões NTSC pelo ar nos Estados Unidos cessou em 1 de janeiro de 2010 e em 31 de agosto de 2011 no Canadá e na maioria dos outros mercados NTSC. A maioria das transmissões NTSC terminou no Japão em 24 de julho de 2011, com as prefeituras japonesas de Iwate, Miyagi e Fukushima terminando no ano seguinte. Depois de um programa piloto em 2013, a maioria das estações analógicas de potência total no México deixou o ar em dez datas em 2015, com cerca de 500 estações de baixa potência e repetidoras que permanecerão em analógico até o final de 2016. A transmissão digital permite maior resolução televisão, mas a televisão digital de definição padrão continua a usar a taxa de quadros e o número de linhas de resolução estabelecidas pelo padrão analógico NTSC.

História

O National Television System Committee (Comitê Nacional do Sistema de Televisão) foi estabelecido em 1940 pela Federal Communications Commission (FCC) dos Estados Unidos para resolver os conflitos entre empresas pela introdução de um sistema nacional de televisão analógica nos Estados Unidos. Em março de 1941, o comitê emitiu um padrão técnico para a televisão em preto-e-branco, baseado em uma recomendação de 1936 feita pela Radio Manufacturers Association (RMA). Avanços técnicos da técnica de banda lateral vestigial permitiram a oportunidade de aumentar a resolução da imagem. O NTSC selecionou 525 linhas de varredura como um compromisso entre o padrão de linha de varredura 441 da RCA e o desejo de Philco e DuMont de aumentar o número de linhas de varredura para entre 605 e 800. O padrão recomendava uma taxa de quadros de 30 quadros por segundo, consistindo de dois campos entrelaçados por quadro em 262,5 linhas por campo e 60 campos por segundo. Outros padrões na recomendação final foram uma relação de aspecto de 4: 3 e modulação de freqüência (FM) para o sinal de som (que era bastante novo na época).

Em janeiro de 1950, o comitê foi reconstituído para padronizar a televisão em cores. A FCC havia aprovado brevemente um padrão de televisão em cores em outubro de 1950, desenvolvido pela CBS. O sistema CBS é incompatível com os receptores em preto e branco existentes. Ele usa uma roda de cores giratória, reduz o número de linhas de varredura de 525 para 405 e aumenta a taxa de campo de 60 para 144, mas tem uma taxa de quadros efetiva de apenas 24 quadros por segundo. A ação legal da rival RCA manteve o uso comercial do sistema fora do ar até junho de 1951, e as transmissões regulares duraram apenas alguns meses antes que a fabricação de todos os televisores coloridos fosse proibida pelo Escritório de Mobilização de Defesa em outubro, aparentemente devido à Guerra da Coréia. . A CBS rescindiu seu sistema em março de 1953, e o FCC substituiu-o em 17 de dezembro de 1953, com o padrão de cores NTSC, que foi cooperativamente desenvolvido por várias empresas, incluindo a RCA e a Philco.

Em dezembro de 1953, a FCC aprovou por unanimidade o que hoje é chamado de padrão de televisão colorida NTSC (mais tarde definido como RS-170a). O padrão de cores compatível mantém total compatibilidade retroativa com os aparelhos de televisão em preto-e-branco existentes. Informações de cor foram adicionadas à imagem em preto-e-branco, introduzindo uma subportadora colorida de precisamente 315/88 MHz (geralmente descrita como 3,579545 MHz ou 3,58 MHz). A frequência precisa foi escolhida para que os componentes de modulação da taxa de linha horizontal do sinal de crominância caiam exatamente entre os componentes de modulação da taxa de linha horizontal do sinal de luminância, permitindo assim que o sinal de crominância seja filtrado do sinal de luminância com menor degradação o sinal de luminância. Devido às limitações dos circuitos do divisor de freqüência no momento em que o padrão de cor foi promulgado, a frequência da subportadora de cor foi construída como freqüência composta montada a partir de inteiros pequenos, neste caso 5 × 7 × 9 / (8 × 11) MHz. A taxa de linha horizontal foi reduzida para aproximadamente 15.734 linhas por segundo (3.579545 × 2/455 MHz = 9/572 MHz) de 15.750 linhas por segundo, e a taxa de quadros foi reduzida para 30 / 1.001 ≈ 29.970 quadros por segundo (a linha horizontal taxa dividida por 525 linhas / quadro) de 30 quadros por segundo. Essas alterações chegam a 0,1% e foram prontamente toleradas pelos receptores de televisão existentes.

A primeira transmissão televisiva anunciada publicamente de um programa usando o sistema “compatível de cores” NTSC foi um episódio de Kukla, Fran e Ollie da NBC em 30 de agosto de 1953, embora fosse visível em cores apenas na sede da rede. A primeira exibição nacional da cor NTSC ocorreu no dia 1 de janeiro seguinte com a transmissão de costa a costa do Torneio de Rosas, visível em protótipos de protótipos em apresentações especiais em todo o país. A primeira câmara de televisão a cores NTSC foi a RCA TK-40, utilizada para transmissões experimentais em 1953; Uma versão melhorada, a TK-40A, lançada em março de 1954, foi a primeira câmera de televisão colorida disponível comercialmente. Mais tarde naquele ano, o TK-41 aperfeiçoado tornou-se a câmera padrão usada em grande parte da década de 1960.

O padrão NTSC foi adotado por outros países, incluindo a maioria das Américas e do Japão.

Com o advento da televisão digital, transmissões analógicas estão sendo eliminadas. A maioria das emissoras NTSC dos EUA foi solicitada pela FCC a encerrar seus transmissores analógicos em 2009. Estações de baixa potência, estações Classe A e tradutores tiveram que ser desligadas até 2015.

Detalhes técnicos

Linhas e taxa de atualização

A codificação de cores NTSC é usada com o sinal de televisão System M, que consiste em 30⁄1.001 (aproximadamente 29.97) quadros entrelaçados de vídeo por segundo. Cada quadro é composto de dois campos, cada um consistindo de 262,5 linhas de varredura, para um total de 525 linhas de varredura. 483 linhas de varredura compõem a varredura visível. O restante (o intervalo de apagamento vertical) permite a sincronização vertical e o retorno. Esse intervalo de apagamento foi originalmente projetado para simplesmente deixar em branco o CRT do receptor para permitir os circuitos analógicos simples e o retrocesso vertical lento dos primeiros receptores de TV. No entanto, algumas dessas linhas agora podem conter outros dados, como closed caption e timecode de intervalo vertical (VITC). Na varredura completa (desconsiderando metade das linhas devido ao entrelaçamento), as linhas de varredura pares (todas as outras linhas que seriam contadas no sinal de vídeo, por exemplo, {2, 4, 6, …, 524}) são desenhadas no primeiro campo, e o ímpar (todas as outras linhas que seriam ímpares se contadas no sinal de vídeo, ex. {1, 3, 5, …, 525}) são desenhadas no segundo campo, para produzir um imagem livre de cintilação na frequência de atualização de campo de 60⁄1.001 Hz (aproximadamente 59.94 Hz). Para fins de comparação, os sistemas 576i, como PAL-B / G e SECAM, usam 625 linhas (576 visíveis) e, portanto, têm uma resolução vertical mais alta, mas uma resolução temporal menor de 25 quadros ou 50 campos por segundo.

A frequência de atualização de campo NTSC no sistema preto-e-branco originalmente correspondia exatamente à frequência nominal de 60 Hz de energia de corrente alternada usada nos Estados Unidos. A correspondência da taxa de atualização de campo com a fonte de energia evitou a intermodulação (também chamada de batida), que produz barras de rolagem na tela. A sincronização da taxa de atualização com a energia ajudou acidentalmente as câmeras do kinescope a registrar transmissões televisivas ao vivo, pois era muito simples sincronizar uma câmera de filme para capturar um quadro de vídeo em cada quadro usando a freqüência de corrente alternada para definir a velocidade do vídeo. câmera síncrona de acionamento por motor CA. Quando a cor foi adicionada ao sistema, a frequência de atualização foi ligeiramente deslocada para baixo em 0,1% para aproximadamente 59,94 Hz para eliminar os padrões de pontos estacionários na diferença de frequência entre as portadoras de som e cor, conforme explicado abaixo em “Codificação de cor”. No momento em que a taxa de quadros mudava para acomodar a cor, era quase tão fácil acionar o obturador da câmera do próprio sinal de vídeo.

O número real de 525 linhas foi escolhido como consequência das limitações das tecnologias baseadas no tubo de vácuo do dia. Nos primeiros sistemas de TV, um oscilador mestre controlado por tensão era executado em duas vezes a freqüência de linha horizontal, e essa freqüência era dividida pelo número de linhas usadas (neste caso, 525) para fornecer a freqüência de campo (60 Hz, neste caso). . Esta frequência foi então comparada com a frequência da linha de alimentação de 60 Hz e qualquer discrepância corrigida pelo ajuste da frequência do oscilador principal. Para a varredura entrelaçada, um número ímpar de linhas por quadro era necessário para tornar a distância de rastreio vertical idêntica para os campos ímpares e pares, o que significava que a freqüência do oscilador mestre tinha que ser dividida por um número ímpar. Na época, o único método prático de divisão de freqüência era o uso de uma cadeia de multivibradores de tubo a vácuo, sendo a razão de divisão total o produto matemático das relações de divisão da cadeia. Como todos os fatores de um número ímpar também têm que ser números ímpares, segue-se que todos os divisores na cadeia também tiveram que dividir por números ímpares, e estes tiveram que ser relativamente pequenos devido aos problemas de desvio térmico com dispositivos de tubo de vácuo. . A sequência prática mais próxima de 500 que atende a esses critérios foi 3 × 5 × 5 × 7 = 525. (Pela mesma razão, 625 linhas PAL-B / G e SECAM usam 5 × 5 × 5 × 5, o antigo sistema britânico de 40 linhas usou 3 × 3 × 3 × 3 × 5, o sistema francês de linha 819 usado 3 × 3 × 7 × 13 etc.)

Colorimetria

A especificação original do NTSC 1953 em cores, ainda parte do Código de Regulamentos Federais dos Estados Unidos, definiu os valores colorimétricos do sistema da seguinte forma:

| Colorimetria original NTSC (1953) | CIE 1931 x | CIE 1931 y |

|---|---|---|

| vermelho primário | 0,67 | 0,33 |

| verde primário | 0,21 | 0,71 |

| azul primário | 0,14 | 0,08 |

| ponto branco (CIE iluminante padrão C) 6774 K | 0,310 | 0,316 |

Os primeiros receptores de televisão em cores, como o RCA CT-100, eram fiéis a essa especificação (que se baseava nos padrões de imagem em movimento predominantes), possuindo uma gama maior do que a maioria dos monitores atuais. Seus fósforos de baixa eficiência (notavelmente no vermelho) eram fracos e persistentes, deixando rastros após a movimentação de objetos. A partir do final dos anos 50, os fósforos dos tubos de imagem sacrificariam a saturação para aumentar o brilho; esse desvio do padrão tanto no receptor quanto no transmissor era a fonte de considerável variação de cor.

SMPTE C

Para garantir uma reprodução de cor mais uniforme, os receptores começaram a incorporar circuitos de correção de cores que convertiam o sinal recebido – codificado para os valores colorimétricos listados acima – em sinais codificados para os fósforos realmente usados no monitor. Como essa correção de cor não pode ser realizada com precisão nos sinais não lineares corrigidos por gama transmitidos, o ajuste só pode ser aproximado, introduzindo tanto os erros de matiz quanto de luminância para cores altamente saturadas.

Da mesma forma, no estágio de radiodifusão, em 1968-69, a Conrac Corp., trabalhando com RCA, definiu um conjunto de fósforos controlados para uso em monitores de vídeo de imagens coloridas. Esta especificação sobrevive hoje como a especificação de fósforo SMPTE “C”:

| Colorimetria SMPTE “C” | CIE 1931 x | CIE 1931 y |

|---|---|---|

| vermelho primário | 0,630 | 0,340 |

| verde primário | 0,310 | 0,595 |

| azul primário | 0,155 | 0,070 |

| ponto branco (iluminante CIE D65) | 0,3127 | 0,3290 |

Como com os receptores domésticos, foi recomendado ainda que os monitores de estúdio incorporem circuitos de correção de cores similares, de forma que os radiodifusores transmitam imagens codificadas para os valores colorimétricos originais de 1953, de acordo com os padrões da FCC.

Em 1987, o Comitê de Tecnologia da Televisão da Society of Motion Picture and Television Engineers (SMPTE), Grupo de Trabalho sobre Colorimetria de Monitor de Estúdio, adotou os fósforos SMPTE C (Conrac) para uso geral na Prática Recomendada 145, levando muitos fabricantes a modificar seus projetos de câmeras codificar diretamente para colorimetria SMPTE “C” sem correção de cor, como aprovado no padrão SMPTE 170M, “Sinal de Vídeo Analógico Composto – NTSC para Aplicações em Estúdio” (1994). Como conseqüência, o padrão de televisão digital ATSC afirma que, para sinais de 480i, a colorimetria SMPTE “C” deve ser considerada, a menos que os dados colorimétricos sejam incluídos no fluxo de transporte.

O NTSC japonês nunca alterou as primárias e o whitepoint para o SMPTE “C”, continuando a usar as primárias NTSC de 1953 e o whitepoint. Ambos os sistemas PAL e SECAM usaram a colorimetria NTSC original de 1953 até 1970; Ao contrário do NTSC, no entanto, a European Broadcasting Union (EBU) rejeitou a correção de cores em receptores e monitores de estúdio naquele ano e, em vez disso, pediu explicitamente que todos os equipamentos codificassem diretamente os valores colorimétricos “EBU”, melhorando ainda mais a fidelidade de cores desses sistemas.

Codificação de cores

Para retrocompatibilidade com a televisão a preto e branco, o NTSC utiliza um sistema de codificação de luminância-crominância inventado em 1938 por Georges Valensi. Os três sinais de imagem a cores são divididos em Luminância (derivada matematicamente dos três sinais de cor separados (Vermelho, Verde e Azul)) que toma o lugar do sinal monocromático original e Crominância, que transporta apenas a informação da cor. Este processo é aplicado a cada fonte de cor por seu próprio Colorplexer, permitindo assim que uma fonte de cor compatível seja gerenciada como se fosse uma fonte monocromática comum. Isso permite que os receptores em preto e branco exibam sinais de cor NTSC simplesmente ignorando o sinal de crominância. Algumas TVs em preto-e-branco vendidas nos EUA após a introdução da transmissão em cores em 1953 foram projetadas para filtrar o croma, mas os primeiros aparelhos da B & W não fizeram isso e a crominância pode ser vista como um ‘padrão de pontos’ em áreas altamente coloridas da imagem.

Em NTSC, a crominância é codificada usando dois sinais de cor conhecidos como I (em fase) e Q (em quadratura) em um processo chamado QAM. Os dois sinais de cada amplitude modulam portadores de 3,58 MHz que estão 90 graus desfasados entre si e o resultado adicionado em conjunto mas com os portadores eles próprios sendo suprimidos. O resultado pode ser visto como uma única onda senoidal com fase variável em relação a uma portadora de referência e com amplitude variável. A fase de variação representa a tonalidade de cor instantânea capturada por uma câmera de TV, e a amplitude representa a saturação de cor instantânea. Esta subportadora de 3,58 MHz é então adicionada à Luminância para formar o ‘sinal de cor composto’ que modula o portador de sinal de vídeo da mesma forma que na transmissão monocromática.

Para que uma TV em cores recupere as informações de matiz da subportadora de cor, ela deve ter uma referência de fase zero para substituir a portadora suprimida anteriormente. O sinal NTSC inclui uma pequena amostra desse sinal de referência, conhecido como colorburst, localizado no “back porch” de cada pulso de sincronização horizontal. A explosão de cor consiste em um mínimo de oito ciclos da subportadora de cor não modulada (fase fixa e amplitude). O receptor de TV tem um “oscilador local”, que é sincronizado com essas rajadas de cor. Combinar este sinal de fase de referência derivado do burst de cor com a amplitude e fase do sinal de crominância permite a recuperação dos sinais ‘I’ e ‘Q’ que, quando combinados com a informação Luminance, permitem a reconstrução de uma imagem colorida no ecrã. Foi dito que a TV a cores realmente tem TV colorida devido à total separação da parte de brilho da imagem da parte colorida. Nos televisores CRT, o sinal NTSC é transformado em três sinais de cor chamados Vermelho, Verde e Azul, cada um controlando aquela pistola de elétrons colorida. Aparelhos de TV com circuitos digitais usam técnicas de amostragem para processar os sinais, mas o resultado final é o mesmo. Para ambos os conjuntos analógicos e digitais processando um sinal analógico NTSC, os três sinais originais de cor (Vermelho, Verde e Azul) são transmitidos usando três sinais discretos (Luminância, I e Q) e depois recuperados como três cores separadas e combinados como imagem colorida. .

Quando um transmissor transmite um sinal NTSC, ele modula em amplitude uma portadora de radiofreqüência com o sinal NTSC que acabou de ser descrito, enquanto modula em frequência uma portadora de 4,5 MHz a mais com o sinal de áudio. Se ocorrer distorção não linear ao sinal de transmissão, a portadora colorida de 3,579545 MHz pode bater com a portadora de som para produzir um padrão de pontos na tela. Para tornar o padrão resultante menos perceptível, os projetistas ajustaram a taxa de linha de varredura original de 15.750 Hz para baixo por um fator de 1.001 (0.1%) para corresponder à frequência de portadora de áudio dividida pelo fator 286, resultando em uma taxa de campo de aproximadamente 59.94 Hz. Esse ajuste garante que as somas e diferenças da portadora de som e da subportadora de cor e seus múltiplos (ou seja, os produtos de intermodulação das duas portadoras) não sejam múltiplos exatos da taxa de quadros, que é a condição necessária para os pontos permanecerem estacionários. na tela, tornando-os mais visíveis.

A taxa de 59,94 é derivada dos seguintes cálculos. Designers optaram por tornar a frequência de subportadora de crominância um múltiplo n + 0,5 da frequência de linha para minimizar a interferência entre o sinal de luminância e o sinal de crominância. (Outra maneira de afirmar isso é que a freqüência da subportadora de cor é um múltiplo ímpar de metade da freqüência de linha.) Eles então escolheram tornar a freqüência de subportadora de áudio um múltiplo inteiro da frequência de linha para minimizar a interferência visível (intermodulação) entre o áudio sinal e o sinal de crominância. O padrão preto-e-branco original, com sua freqüência de linha de 15.750 Hz e subportadora de áudio de 4.5 MHz, não atende a esses requisitos, portanto, os projetistas tiveram que aumentar a frequência da subportadora de áudio ou diminuir a frequência da linha. Aumentar a frequência da subportadora de áudio impediria que os receptores existentes (preto e branco) sintonizassem corretamente o sinal de áudio. Diminuir a frequência de linha é comparativamente inócuo, porque a informação de sincronização horizontal e vertical no sinal NTSC permite que um receptor tolere uma quantidade substancial de variação na frequência de linha. Assim, os engenheiros escolheram a frequência de linha a ser alterada para o padrão de cores. No padrão preto-e-branco, a razão entre a freqüência da subportadora de áudio e a freqüência da linha é de 4,5 MHz ± 15.750 Hz = 285,71. No padrão de cor, isso se torna arredondado para o inteiro 286, o que significa que a taxa de linha do padrão de cor é de 4,5 MHz a 2,86 ± 15,734 Hz. Mantendo o mesmo número de linhas de varredura por campo (e quadro), a taxa de linha inferior deve produzir uma taxa de campo menor. Dividindo 4.500.000 × 2.886 linhas por segundo por 262,5 linhas por campo, obtém-se aproximadamente 59,94 campos por segundo.

Método de modulação de transmissão

Um canal de televisão NTSC, conforme transmitido, ocupa uma largura de banda total de 6 MHz. O sinal de vídeo real, que é modulado em amplitude, é transmitido entre 500 kHz e 5,45 MHz acima do limite inferior do canal. A portadora de vídeo está 1,25 MHz acima do limite inferior do canal. Como a maioria dos sinais AM, o portador de vídeo gera duas bandas laterais, uma acima da portadora e outra abaixo. As bandas laterais são cada uma com 4.2 MHz de largura. Toda a banda lateral superior é transmitida, mas somente 1,25 MHz da banda lateral inferior, conhecida como banda lateral vestigial, é transmitida. A subportadora de cor, como notado acima, é 3,579545 MHz acima da portadora de vídeo, e é modulada em amplitude de quadratura com uma portadora suprimida. O sinal de áudio é modulado em frequência, como os sinais de áudio transmitidos por estações de rádio FM na faixa 88–108 MHz, mas com um desvio de frequência máximo de 25 kHz, ao contrário de 75 kHz como é usado na banda FM, tornando a televisão analógica os sinais de áudio soam mais silenciosos do que os sinais de rádio FM recebidos em um receptor de banda larga. A portadora de áudio principal é de 4,5 MHz acima da portadora de vídeo, tornando-a 250 kHz abaixo da parte superior do canal. Às vezes, um canal pode conter um sinal MTS, que oferece mais de um sinal de áudio, adicionando uma ou duas subportadoras no sinal de áudio, cada uma sincronizada com um múltiplo da frequência da linha. Este é normalmente o caso quando são utilizados sinais de áudio estéreo e / ou segundos programas de áudio. As mesmas extensões são usadas no ATSC, onde a portadora digital ATSC é transmitida a 0.31 MHz acima do limite inferior do canal.

“Setup” é um offset de tensão de 54 mV (7,5 IRE) entre os níveis “black” e “blanking”. É exclusivo do NTSC. CVBS significa Color, Video, Blanking e Sync.

Conversão da taxa de quadros

Há uma grande diferença na taxa de quadros entre o filme, que é de 24,0 quadros por segundo, e o padrão NTSC, que é executado em aproximadamente 29,97 (10 MHz × 63/88/455/525) quadros por segundo. Em regiões que usam padrões de televisão e vídeo de 25 fps, essa diferença pode ser superada pela aceleração.

Para padrões de 30-fps, um processo chamado “3: 2 suspenso” é usado. Um quadro de filme é transmitido para três campos de vídeo (com duração de 1 ½ quadros de vídeo) e o quadro seguinte é transmitido para dois campos de vídeo (duração de 1 quadro de vídeo). Dois quadros de filme são então transmitidos em cinco campos de vídeo, para uma média de 2½ campos de vídeo por quadro de filme. A taxa de quadros média é, portanto, de 60 ÷ 2.5 = 24 quadros por segundo, portanto, a velocidade média do filme é nominalmente exatamente o que deveria ser. (Na realidade, ao longo de uma hora em tempo real, 215.827.2 campos de vídeo são exibidos, representando 86.330,88 quadros de filme, enquanto em uma hora de verdadeira projeção de filme de 24 fps, exatamente 86.400 quadros são mostrados: assim, 29.97-fps NTSC A transmissão do filme de 24 fps é executada a 99,92% da velocidade normal do filme.) O enquadramento na reprodução pode exibir um quadro de vídeo com campos de dois quadros de filme diferentes, portanto, qualquer diferença entre os quadros aparecerá como um retrocesso rápido. diante de cintilação. Também pode haver jitter / “gaguejo” perceptível durante panelas de câmera lenta (telecine trepidação).

Para evitar um pulldown de 3: 2, o filme filmado especificamente para a televisão NTSC é geralmente tirado a 30 quadros / s.

Para mostrar material de 25 fps (como séries de televisão européias e alguns filmes europeus) em equipamentos NTSC, cada quinto quadro é duplicado e, em seguida, o fluxo resultante é entrelaçado.

A captura de filme para televisão NTSC a 24 quadros por segundo foi tradicionalmente acelerada em 1/24 (para cerca de 104,17% da velocidade normal) para transmissão em regiões que usam padrões de televisão de 25 fps. Este aumento na velocidade da imagem tem sido acompanhado tradicionalmente por um aumento similar no pitch e tempo do áudio. Mais recentemente, a combinação de quadros foi usada para converter 24 FPS para 25 FPS sem alterar sua velocidade.

Filme filmado para televisão em regiões que usam padrões de televisão de 25-fps pode ser tratado de duas maneiras:

O filme pode ser gravado a 24 quadros por segundo. Neste caso, quando transmitido em sua região nativa, o filme pode ser acelerado a 25 qps de acordo com a técnica analógica descrita acima, ou mantido a 24 qps pela técnica digital descrita acima. Quando o mesmo filme é transmitido em regiões que usam um padrão de televisão nominal de 30 fps, não há mudanças perceptíveis na velocidade, no andamento e no tom.

O filme pode ser gravado a 25 quadros por segundo. Neste caso, quando transmitido em sua região nativa, o filme é mostrado em sua velocidade normal, sem alteração da trilha sonora que o acompanha. Quando o mesmo filme é exibido em regiões que usam um padrão de televisão nominal de 30 fps, cada quinto quadro é duplicado e ainda não há alterações perceptíveis na velocidade, no andamento e no tom.

Como as duas velocidades de filme foram usadas em regiões de 25 fps, os espectadores podem enfrentar confusão sobre a velocidade real de vídeo e áudio, e o tom de vozes, efeitos sonoros e apresentações musicais, em filmes de televisão dessas regiões. Por exemplo, eles podem se perguntar se a série de filmes de Sherlock Holmes, feitos nos anos 80 e início dos anos 90, foi filmada a 24 fps e transmitida em velocidade artificialmente rápida em regiões de 25 fps, ou se foi filmada em 25 qps nativamente e depois diminuiu para 24 qps para a exibição NTSC.

Essas discrepâncias existem não apenas em transmissões de televisão pelo ar e por cabo, mas também no mercado de vídeo doméstico, tanto em fitas quanto em discos, incluindo discos a laser e DVD.

Na televisão digital e no vídeo, que estão substituindo seus antecessores analógicos, os padrões únicos que podem acomodar uma faixa mais ampla de taxas de quadros ainda mostram os limites dos padrões regionais analógicos. O padrão ATSC, por exemplo, permite taxas de quadros de 23,976, 24, 29,97, 30, 59,94 e 60 quadros por segundo, mas não 25 e 50.

Modulação para transmissão analógica por satélite

Como a potência do satélite é severamente limitada, a transmissão de vídeo analógico através de satélites difere da transmissão de TV terrestre. AM é um método de modulação linear, portanto, uma dada relação sinal-ruído desmodulada (SNR) requer um SNR RF igualmente elevado. O SNR do vídeo com qualidade de estúdio é superior a 50 dB, portanto, o AM exigiria potências proibitivamente altas e / ou antenas grandes.

O FM de banda larga é usado para trocar a largura de banda de RF por energia reduzida. Aumentar a largura de banda do canal de 6 para 36 MHz permite um SNR RF de apenas 10 dB ou menos. A maior largura de banda de ruído reduz essa economia de energia de 40 dB em 36 MHz / 6 MHz = 8 dB para uma redução substancial de 32 dB.

O som está em uma subportadora FM, como na transmissão terrestre, mas freqüências acima de 4,5 MHz são usadas para reduzir a interferência auditiva / visual. 6,8, 5,8 e 6,2 MHz são comumente usados. O estéreo pode ser multiplex, discreto ou de matriz e não relacionado áudio e os sinais de dados podem ser colocados em subportadoras adicionais.

Uma forma de onda de dispersão de energia triangular de 60 Hz é adicionada ao sinal de banda base composta (vídeo mais subportadoras de áudio e dados) antes da modulação. Isso limita a densidade espectral de potência do downlink de satélite caso o sinal de vídeo seja perdido. Caso contrário, o satélite poderá transmitir toda a sua potência em uma única freqüência, interferindo nos links de microondas terrestres na mesma faixa de freqüência.

No modo de meio transponder, o desvio de frequência do sinal de banda base compósito é reduzido para 18 MHz para permitir outro sinal na outra metade do transponder de 36 MHz. Isto reduz um pouco o benefício de FM, e os SNRs recuperados são ainda mais reduzidos porque a potência de sinal combinada deve ser “recuada” para evitar distorção de intermodulação no transponder de satélite. Um único sinal de FM é uma amplitude constante, para que possa saturar um transponder sem distorção.

Ordem do Campo

Um “quadro” NTSC consiste em um campo “par” seguido de um campo “ímpar”. No que diz respeito à recepção de um sinal analógico, isso é puramente uma questão de convenção e não faz diferença. É como as linhas quebradas correndo no meio de uma estrada, não importa se é um par de linha / espaço ou um par de espaço / linha; o efeito para um driver é exatamente o mesmo.

A introdução de formatos de televisão digital mudou um pouco as coisas. A maioria dos formatos de TV digital armazena e transmite campos em pares como um único quadro digital. Os formatos digitais que correspondem à taxa de campo NTSC, incluindo o popular formato DVD, gravam vídeo com o campo par em primeiro lugar no quadro digital, enquanto os formatos que correspondem à taxa de campo do sistema de 625 linhas normalmente gravam vídeo com quadro ímpar primeiro. Isso significa que, ao reproduzir muitos formatos digitais não baseados em NTSC, é necessário reverter a ordem dos campos, caso contrário, um efeito inaceitável “comb” ocorre em objetos em movimento, conforme são mostrados à frente em um campo e, em seguida, retornam no próximo.

Isso também se tornou um perigo quando vídeo progressivo não-NTSC é transcodificado para entrelaçado e vice-versa. Sistemas que recuperam quadros progressivos ou transcodificam vídeo devem garantir que a “Ordem de Campo” seja obedecida, caso contrário o quadro recuperado consistirá em um campo de um quadro e um campo de um quadro adjacente, resultando em artefatos de entrelaçamento “comb”. Isto pode ser observado frequentemente em utilitários de reprodução de vídeo baseados em PC, se for feita uma escolha inadequada do algoritmo de desentrelaçamento.

Durante as décadas de transmissões NTSC de alta potência nos Estados Unidos, a alternância entre as visualizações de duas câmeras foi realizada de acordo com dois padrões, a escolha entre os dois sendo feita por geografia, leste versus oeste. Em uma região, a troca era feita entre o campo ímpar que terminava um quadro e o campo par que iniciava o próximo quadro; no outro, a troca foi feita após um campo par e antes de um campo ímpar. Assim, por exemplo, uma gravação VHS caseira feita de um telejornal local no Oriente, quando em pausa, mostraria apenas a vista de uma câmera (a menos que uma dissolução ou outra tomada multicamera fosse pretendida), enquanto a reprodução VHS de uma comédia de situação gravado e editado em Los Angeles e depois transmitido em todo o país poderia ser pausado no momento de uma troca entre câmeras com metade das linhas representando o tiro de saída e a outra metade representando o tiro recebido.