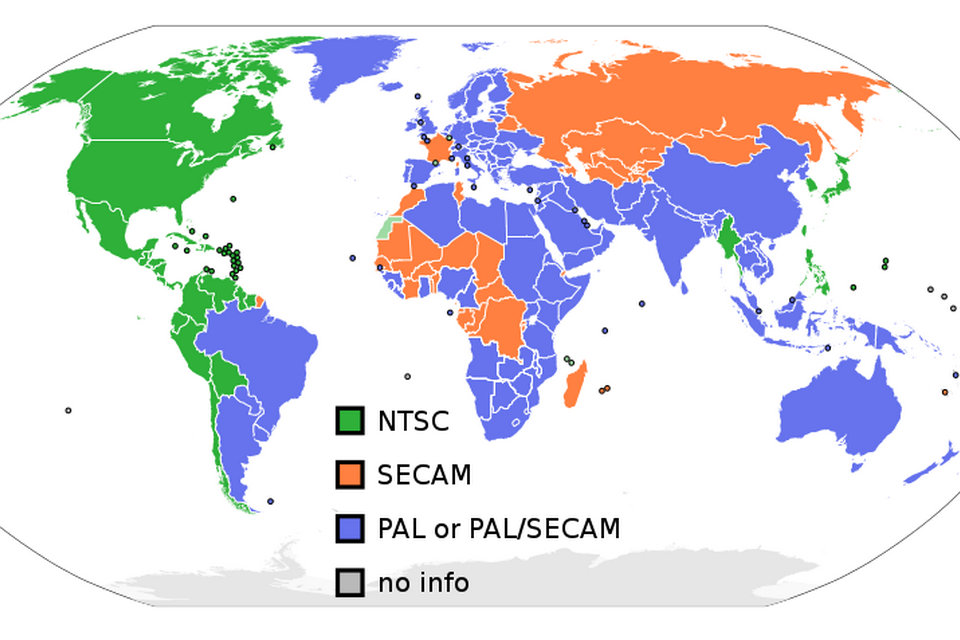

NTSCは、全米テレビシステム委員会にちなんで命名され、北米で使用されるアナログテレビシステムであり、デジタル変換が大部分のアメリカ(ブラジル、アルゼンチン、パラグアイ、ウルグアイ、フランスギガナを除く)で使用されるまでです。 ミャンマー; 韓国; 台湾; フィリピン、日本; いくつかの太平洋諸島諸国と領土である。

最初のNTSC規格は1941年に開発されたもので、色の規定はありませんでした。 1953年には、既存のモノクロ受信機と互換性のあるカラーテレビ放送を可能にする第2のNTSC規格が採用された。 NTSCは広く普及した最初の放送カラーシステムであり、2000年代になるとATSCなどの異なるデジタル規格に置き換えられ始めました。

NTSC規格を使用しているほとんどの国は、他のアナログテレビ規格を使用している国と同様に、新しいデジタルテレビ規格に切り替えるか、または世界中の少なくとも4つの異なる標準が使用されています。 北米、中米、韓国の一部はATSC基準を採用しているか、採用しているが、他の国(日本など)はATSCではなく他の基準を採用している。 ほぼ70年後、米国における大部分の無線NTSC伝送は、2010年1月1日に終了し、カナダおよび他のほとんどのNTSC市場で2011年8月31日までに終了しました。 2011年7月24日にNTSCの大部分が日本で終了し、岩手県、宮城県、福島県の各県が翌年に終了しました。 2013年のパイロットプログラムの後、2015年にメキシコのほとんどのフルパワーアナログステーションが10日間放置され、2016年末までに約500の低電力およびリピータステーションがアナログ状態を維持できます。デジタル放送では、デジタル標準テレビジョンは、アナログNTSC規格によって確立されたフレームレートおよび解像度ラインの数を引き続き使用している。

歴史

全米のアナログテレビシステムを米国で導入したことによる企業間の紛争を解決するために、米国の連邦通信委員会(FCC)によって1940年に設立された。 1941年3月に、委員会は、ラジオ製造者協会(RMA)が1936年に勧告したモノクロテレビの技術標準を発表した。 残留側波帯技術の技術的進歩は、画像解像度を高める機会を可能にした。 NTSCは、RCAの441走査線規格とPhilco’sとDuMontとの間の妥協点として525本の走査線を選択した。走査線の数を605と800の間に増加させたいという要望がある。標準では、毎秒30フレーム(画像)フィールド当たり262.5ラインと毎秒60フィールドで、フレーム当たり2つのインターレースフィールドを有する。 最終勧告の他の標準は、アスペクト比が4:3で、音声信号(当時は非常に新しい)の周波数変調(FM)でした。

1950年1月に、委員会はカラーテレビを標準化するために再構成されました。 FCCは、CBSによって開発された1950年10月にカラーテレビ規格を短期間で承認した。 CBSシステムは、既存のモノクロ受信機と互換性がありません。 回転カラーホイールを使用し、スキャンラインの数を525から405に減らし、フィールドレートを60から144に増加させますが、有効フレームレートはわずか24フレーム/秒です。 ライバルのRCAによる法的措置は、1951年6月までこのシステムを商業的に使用し続け、規則的な放送は、10月に全国カラーテレビの製造が国防総省によって禁止された数ヶ月前に終わったに過ぎなかった。 CBSは1953年3月にシステムを廃止し、FCCは1953年12月17日にそれをRCAとPhilcoを含むいくつかの企業によって共同開発されたNTSCカラー標準に置き換えました。

1953年12月、FCCは現在、NTSCカラーテレビジョン規格(後でRS-170aと定義)を全会一致で承認しました。 互換性のあるカラースタンダードは、既存の白黒テレビセットとの完全な下位互換性を保持する。 カラー情報は、315 / 88MHzのカラーサブキャリア(通常は3.579545MHzまたは3.58MHzと記載)を導入することによって、白黒画像に追加されました。 正確な周波数は、クロミナンス信号の水平ラインレート変調成分が輝度信号の水平ラインレート変調成分の間に正確に入るように選択され、これによりクロミナンス信号が輝度信号からフィルタリングされ、輝度信号。 カラー標準が公表された時点での分周器回路の制限のため、カラーサブキャリア周波数は、小さい整数、この場合5×7×9 /(8×11)MHzから組み立てられた合成周波数として構成された。 水平ラインレートは、15,750ライン/秒から約15,734ライン/秒(3.579545×2 / 455MHz = 9/572MHz)に減少し、フレームレートは30 / 1.001≒29.970フレーム/秒(水平ラインレートを525ライン/フレームで割った値)を30フレーム/秒から計算します。 これらの変化は0.1%にも及び、既存のテレビジョン受信機によって容易に許容された。

NTSCの「互換性のあるカラー」システムを使用したプログラムの最初に公表されたネットワークテレビジョン放送は、ネットワークの本部でのみ見えるが、1953年8月30日のNBCのKukla、Fran and Ollieのエピソードであった。 NTSCカラーの最初の全国的な視聴は、全米の特別プレゼンテーションでプロトタイプカラーレシーバーで見ることができるトーナメントオブローゼズパレードの海岸から海岸までの放送で、1月1日に開始されました。 最初のカラーNTSCテレビカメラはRCA TK-40で、1953年の実験放送に使用されました。 1954年3月に導入された改良型のTK-40Aは、初めて市販されたカラーテレビカメラでした。 その年後半には、改良されたTK-41が1960年代の大部分にわたって使用された標準カメラになりました。

NTSC規格は、アメリカと日本のほとんどを含む他の国々でも採用されています。

デジタルテレビの登場により、アナログ放送は段階的に廃止されつつあります。 ほとんどの米国のNTSC放送局は、2009年にアナログ送信機をシャットダウンするようにFCCに要求されました。2015年までに低出力のステーション、クラスAのステーションおよびトランスレータが停止する必要がありました。

技術的な詳細

ラインとリフレッシュレート

NTSCカラーエンコーディングは、システムMのテレビ信号で使用され、30 / 1.001(およそ29.97)インターレースフレームのビデオ/秒で構成されます。 各フレームは2つのフィールドで構成され、各フィールドは262.5本の走査線で構成され、合計525本の走査線があります。 483の走査線が可視ラスタを構成する。 残りの部分(垂直ブランキング間隔)は垂直同期とリトレースが可能です。 このブランキング・インターバルは、もともと、受信機のCRTを単純にブランクにして、シンプルなアナログ回路と、初期のテレビ受信機の垂直帰線時間の遅さを考慮して設計されました。 ただし、これらの行の一部には、クローズドキャプションや垂直インターバルタイムコード(VITC)などの他のデータが含まれることがあります。 完全なラスタ(インターレースによるハーフラインを無視する)では、偶数番目の走査線(例えば、ビデオ信号内でカウントされても1ラインおき、例えば、{2,4,6、…、524})が描画される(例えば、1,3,5、…、525)が第2のフィールドに描かれて、第1のフィールドには奇数の(ビデオ信号でカウントされれば奇数である) 60/1.001Hz(約59.94Hz)のフィールドリフレッシュ周波数でフリッカーフリーの画像を生成する。 比較のため、PAL-B / GやSECAMなどの576iシステムは625ライン(576本)を使用するため、垂直解像度は高くなりますが、25フレームまたは50フィールド/秒の時間分解能は低くなります。

NTSCフィールドリフレッシュ周波数は、もともと、米国で使用されていた交流電力の公称60Hz周波数と正確に一致していました。 フィールドリフレッシュレートを電源に合わせると、画面上にローリングバーを生成する相互変調(拍動とも呼ばれる)が回避されました。 瞬間的に助けられたキネスコープカメラは、フィルムフレームを同期させて、各フィルムフレームの1フレームのビデオをキャプチャするのは非常に簡単だったので、同期ACモータ駆動カメラ。 システムに色を加えたとき、リフレッシュ周波数は、下の「カラーエンコーディング」で説明されているように、サウンドキャリアとカラーキャリアの差周波数の固定ドットパターンを除去するために、0.1%だけ約59.94Hzにわずかに下にシフトしました。 カラーに対応するようにフレームレートが変更されるまでに、ビデオ信号自体からカメラのシャッターをトリガーすることはほぼ容易でした。

実際の525ラインの数字は、当日の真空管ベースの技術の限界の結果として選ばれました。 初期のテレビシステムでは、主電圧制御発振器を水平ライン周波数の2倍で動作させ、この周波数を使用するライン数(この場合525)で除算してフィールド周波数(この場合は60Hz)を与え、 。 この周波数は、60Hzの電力線周波数と比較され、マスター発振器の周波数を調整することによって補正された不一致が生じた。 インターレース走査では、垂直帰線距離を奇数フィールドと偶数フィールドで同一にするためにフレーム当たり奇数ラインが必要であり、これはマスタ発振器周波数を奇数で分割しなければならないことを意味した。 当時、周波数分割の唯一の実用的な方法は、一連の真空管マルチバイブレータの使用であり、全体の分割比は鎖の分割比の数学的積であった。 奇数のすべての要素も奇数でなければならないので、チェーンのすべての分周器も奇数で除算しなければならず、これらは真空管装置による熱ドリフトの問題のために比較的小さくなければならなかった。 これらの基準を満たす500に最も近い実際のシーケンスは、3×5×5×7 = 525であった。 (同様の理由で、625ラインのPAL-B / GとSECAMは5×5×5×5を使用していました。古いイギリスの405ラインシステムは3×3×3×3×5を使用していました。 3×3×7×13など)

測色

依然として連邦規則の米国コードの一部である元の1953年のカラーNTSC仕様は、以下のようにシステムの比色値を定義した:

| オリジナルのNTSC測色(1953) | CIE 1931 x | CIE 1931年 |

|---|---|---|

| 一次赤 | 0.67 | 0.33 |

| 一次緑 | 0.21 | 0.71 |

| 一次青 | 0.14 | 0.08 |

| 白色点(CIE標準光源C)6774K | 0.310 | 0.316 |

RCA CT-100のような初期のカラーテレビジョン受信機は、この仕様(現行の映画規格に基づいている)に忠実であり、今日のモニターの大部分より広い範囲を有していました。 彼らの低効率蛍光体(特に赤色)は弱く長持ちしており、動く物体の後ろに跡が残っています。 1950年代後半から、ピクチャーチューブの蛍光体は輝度を上げるために飽和を犠牲にします。 受信機と放送局の両方の標準からのこの偏差は、かなりの色の変化の原因であった。

SMPTE C

より均一な色再現を実現するために、受信機は、上記の測色値のために符号化された受信信号を、モニター内で実際に使用される蛍光体のために符号化された信号に変換する色補正回路を組み込みました。 このような色補正は、送信される非線形ガンマ補正された信号に対して正確に実行することができないので、調整は近似することしかできず、色飽和度の高い色に対して色相誤差と輝度誤差の両方を導入する。

同様に、放送局の段階では、1968-69年にコンラク社はRCAと共同で、放送用のカラー映像モニターに使用される制御された蛍光体のセットを定義しました。 この仕様は、SMPTEの “C”蛍光体仕様として現在も存続しています。

| SMPTE “C”比色計 | CIE 1931 x | CIE 1931年 |

|---|---|---|

| 一次赤 | 0.630 | 0.340 |

| 一次緑 | 0.310 | 0.595 |

| 一次青 | 0.155 | 0.070 |

| 白色点(CIE光源D65) | 0.3127 | 0.3290 |

家庭用レシーバと同様に、スタジオモニターにも同様の色補正回路が組み込まれているため、FCC規格に準拠した元の1953色彩値のエンコードされた画像を放送者が送信することができます。

1987年には、SMPTE(Television and Television Engineers)委員会が、推奨プラクティス145で一般的に使用されているSMPTE C(Conrac)蛍光体を採用し、多くのメーカーにカメラのデザインを変更させましたSMPTE標準170M、 “Composite Analog Video Signal – NTSC for Studio Applications”(1994)で承認されているように、色補正なしのSMPTE “C”測色を直接エンコードすることができます。 その結果、ATSCデジタルテレビジョン標準では、測色データがトランスポートストリームに含まれていない限り、480i信号の場合、SMPTE “C”測色が仮定されるべきであると述べています。

日本のNTSCはプライマリとホワイトポイントをSMPTE “C”に変更していないため、1953年のNTSCプライマリとホワイトポイントを引き続き使用していました。 PALとSECAMの両方のシステムでは、1970年までは元の1953年のNTSC測色も使用されていました。 しかし、NTSCとは異なり、EBU(European Broadcasting Union)はその年の受信機とスタジオモニターの色補正を拒否し、すべての機器が “EBU”比色値の信号を直接エンコードするよう明示し、これらのシステムのカラー忠実度をさらに向上させました。

カラーエンコーディング

白黒テレビとの下位互換性のために、NTSCは1938年にGeorges Valensiによって発明された輝度 – クロミナンス符号化方式を使用しています。 3つのカラー画像信号は、元のモノクロ信号に代わる3つの別個の色信号(赤、緑および青)からの輝度(色度情報のみを運ぶクロミナンス)から輝度に分割される。 このプロセスは、各自のColorplexerによって各カラーソースに適用され、互換性のあるカラーソースを通常のモノクロソースのように管理することができます。 これにより、モノクロ受信機は、クロミナンス信号を無視するだけでNTSCカラー信号を表示できます。 1953年にカラー放送が開始された後に米国で販売された一部の白黒テレビは、彩度をフィルタリングするように設計されていましたが、初期のB&Wセットはこれを行わず、色の濃い部分画像の

NTSCでは、QAMと呼ばれるプロセスでI(同相)とQ(直交)の2つの色信号を使用してクロミナンスが符号化されます。 これらの2つの信号は、互いに位相が90度ずれた3.58MHzのキャリアをそれぞれ振幅変調し、結果を一緒に加算するが、キャリア自体は抑制される。 この結果は、基準キャリアおよび振幅の変化に対して位相が変化する単一の正弦波として見ることができる。 変化する位相は、TVカメラによって捕捉された瞬間的な色相を表し、振幅は、瞬間的な彩度を表す。 この3.58MHz副搬送波は輝度に加えられて、モノクロ伝送と同様にビデオ信号搬送波を変調する「合成カラー信号」を形成する。

色副搬送波から色相情報を復元するカラーTVの場合、前に抑制された搬送波を置き換えるために、位相基準がゼロでなければならない。 NTSC信号は、各水平同期パルスの「バックポーチ」上に位置する、カラーバーストとして知られているこの基準信号の短いサンプルを含む。 カラーバーストは、最小8サイクルの無変調(固定位相および振幅)カラーサブキャリアからなる。 TV受信機には、これらのカラーバーストと同期する「ローカル発振器」があります。 カラーバーストから得られたこの基準位相信号をクロミナンス信号の振幅および位相と組み合わせることにより、輝度情報と組み合わされたときにスクリーン上のカラー画像の再構成が可能になる「I」および「Q」信号の回復が可能になる。 カラーテレビは、実際には色の部分から画像の明るさの部分が完全に分離されているため、カラーテレビと言われています。 CRTテレビでは、NTSC信号は、それぞれカラー電子銃を制御する赤、緑、青と呼ばれる3つの色信号に変換されます。 デジタル回路を備えたテレビは、サンプリング技術を使用して信号を処理しますが、最終結果は同じです。 アナログNTSC信号を処理するアナログとデジタルの両方のセットに対して、元の3つの色信号(赤、緑および青)は3つの離散信号(輝度、IおよびQ)を使用して伝送され、次に3つの別個の色として復元され、 。

送信機がNTSC信号をブロードキャストすると、それは直前のNTSC信号で無線周波数キャリアを振幅変調し、それと同時に4.5MHz高いキャリアを周波数変調する。 放送信号に非線形歪みが生じた場合、3.579545MHzカラーキャリアは、音声キャリアとぶつかり、スクリーン上にドットパターンを生成することがある。 得られたパターンをあまり目立たなくするために、設計者は、オリジナルの15,750Hzの走査線速度を、オーディオキャリア周波数を係数286で割った値に一致するように1.001(0.1%)だけ調整し、約59.94Hzのフィールドレートにしました。 この調整は、音声搬送波と色副搬送波とそれらの倍数(すなわち、2つの搬送波の相互変調積)の和と差が、フレームレートの正確な倍数ではないことを保証する。それらを最も顕著にする。

59.94レートは、以下の計算から導かれる。 設計者は、輝度信号とクロミナンス信号との間の干渉を最小にするために、クロミナンス副搬送波周波数をライン周波数のn + 0.5倍にすることを選択した。 (これはしばしば、カラーサブキャリア周波数がライン周波数の半分の奇数倍であるということです。)次に、オーディオサブキャリア周波数をライン周波数の整数倍にすることで、オーディオ間の可視(相互変調)信号およびクロミナンス信号を含む。 15,750 Hzのライン周波数と4.5 MHzのオーディオサブキャリアを備えた元のモノクロ標準は、これらの要件を満たしていないため、設計者はオーディオサブキャリア周波数を上げるか、またはライン周波数を低くする必要がありました。 オーディオ副搬送波周波数を上げると、既存の(黒と白の)受信機がオーディオ信号を適切に同調させることが防止される。 NTSC信号の水平および垂直同期情報は、受信機がライン周波数のかなりの量の変動に耐えることができるので、ライン周波数を下げることは比較的無害である。 そこで、エンジニアは色標準のために変更するライン周波数を選択しました。 白黒標準では、ライン周波数に対するオーディオ副搬送波周波数の比は、4.5MHz / 15,750Hz = 285.71である。 カラースタンダードでは、これは整数286に丸められます。これは、カラースタンダードのラインレートが4.5 MHz / 2,86≒15,734 Hzであることを意味します。 1フィールド(およびフレーム)あたり同じ数の走査線を維持すると、低いラインレートはより低いフィールドレートをもたらさなければならない。 フィールド当たり262.5ラインで毎秒4500000/286ラインを分割すると、毎秒約59.94フィールドが得られます。

伝送変調方式

送信されるNTSCテレビチャネルは、6MHzの全帯域幅を占有する。 振幅変調された実際のビデオ信号は、チャネルの下限よりも500kHz〜5.45MHz上で送信されます。 ビデオキャリアは、チャネルの下限の1.25MHz上にあります。 ほとんどのAM信号と同様に、ビデオキャリアは2つの側波帯を生成します。一方は搬送波の上に、もう一方は下にあります。 側波帯はそれぞれ4.2MHz幅である。 上側の側波帯全体が送信されるが、残留側波帯として知られている1.25MHzの下側波帯のみが送信される。 上述したように、カラー副搬送波は、ビデオキャリアよりも3.579545MHz高く、抑圧された搬送波で直交振幅変調される。 オーディオ信号は、88~108MHz帯域のFMラジオ局によって放送されるオーディオ信号のように周波数変調されるが、FM帯域で使用される75kHzとは対照的に25kHz最大周波数偏差を有し、アナログテレビジョンオーディオ信号は、広帯域受信機で受信したFMラジオ信号よりも静かに聞こえます。 メインオーディオキャリアはビデオキャリアの4.5MHz上にあり、チャネルの最上部より250kHz下になります。 時には、チャネルにMTS信号が含まれている場合があります。MTS信号は、オーディオ信号に1つまたは2つの副搬送波を追加して複数のオーディオ信号を提供し、それぞれがライン周波数の倍数に同期します。 これは、通常、ステレオオーディオ信号および/または第2のオーディオプログラム信号が使用される場合に当てはまる。 同じ拡張がATSCで使用され、ATSCデジタルキャリアはチャネルの下限より0.31MHz上でブロードキャストされる。

「セットアップ」は、「黒」レベルと「ブランキング」レベルの間の54 mV(7.5 IRE)の電圧オフセットです。 これはNTSCに特有のものです。 CVBSはColor、Video、Blanking、Syncの略です。

フレームレート変換

毎秒24.0フレームで動作するフィルムと、毎秒約29.97(10MHz×63/88/455/525)フレームで動作するNTSC規格のフレームレートには大きな違いがあります。 25 fpsのテレビとビデオ規格を使用する地域では、この違いはスピードアップによって克服できます。

30 fps規格では、「3:2プルダウン」と呼ばれるプロセスが使用されます。 1つのフィルムフレームは3つのビデオフィールド(1/2ビデオフレーム持続)に対して送信され、次のフレームは2つのビデオフィールド(1つのビデオフレームに続く)に対して送信される。 このように、2つのフィルムフレームが、5つのビデオフィールドで伝送され、フィルムフレーム当たり平均2 1/2のビデオフィールドが伝送される。 したがって、平均フレームレートは60÷2.5 = 24フレーム/秒であるため、平均フィルムスピードは名目上正確に必要なものです。 (現実には、リアルタイムの1時間に亘って215,827.2のビデオフィールドが表示され、86,330.88フレームのフィルムを表し、真の24fpsのフィルム投影の1時間で正確に86,400フレームが表示される:したがって、29.97fpsのNTSC )再生時に静止画を再生すると、2つの異なるフィルムフレームのフィールドを含むビデオフレームが表示されるため、フレーム間の差異は急速な前後の動きとして表示されます。前方のちらつき。 遅いカメラパン(テレシネジャーダー)の間に目立つジッター/「吃音」もあります。

3:2プルダウンを避けるために、NTSCテレビ向けに撮影されたフィルムは、しばしば30フレーム/秒で撮影されます。

NTSC装置で25 fpsの素材(ヨーロッパのテレビシリーズや一部のヨーロッパ映画など)を表示するには、5番目ごとのフレームが複製され、その結果のストリームがインターレースされます。

通常、NTSCテレビの24コマ/秒のフィルムショットは、25 fpsのテレビ規格を使用する地域では、伝送の1/24(通常速度の約104.17%)まで加速されています。 この画像スピードの増加は、従来、オーディオのピッチとテンポの同様の増加を伴う。 最近では、速度を変えずに24 FPSビデオを25 FPSに変換するためにフレームブレンドが使用されています。

25 fpsのテレビ規格を使用する地域でのテレビ向けのフィルムショットは、次の2つの方法のいずれかで処理できます。

フィルムは24フレーム/秒で撮影できます。 この場合、フィルムはその固有の領域で透過されると、上述のアナログ技術に従って25fpsに加速されるか、または上述のデジタル技術によって24fpsで維持される。 同一のフィルムが名目上の30fpsのテレビジョン規格を使用する地域で送信される場合、速度、テンポ、およびピッチの顕著な変化はありません。

このフィルムは毎秒25フレームで撮影できます。 この場合、ネイティブリージョンで送信されると、映画は通常の速度で表示され、付随するサウンドトラックは変更されません。 同一のフィルムが30fpsの公称テレビジョン規格を使用する領域に示されている場合、5番目ごとのフレームが複製され、速度、テンポ、およびピッチの顕著な変化はない。

両方のフィルムスピードが25fpsの地域で使用されているため、視聴者は、それらの地域のテレビ映画で、ビデオとオーディオの真のスピード、音声、効果音、音楽パフォーマンスのピッチについて混乱することがあります。 例えば、1980年代から1990年代初頭にかけて制作されたシャーロック・ホームズのテレビ映画「ジェレミー・ブレット(Jeremy Brett)」シリーズが、24fpsで撮影された後、25fpsの地域で人工的に高速で送信されたのか、ネイティブに25 fps、その後NTSCで24 fpsに減速しました。

このような相違は、大気やケーブルを介したテレビジョン放送だけでなく、レーザーディスクやDVDなどのテープとディスクのホームビデオ市場にも存在します。

アナログの先行技術を置き換えているデジタルテレビやビデオでは、広範囲のフレームレートに対応できる単一規格が、アナログ地域規格の限界を示しています。 たとえば、ATSC規格では、23.976,24,29.97,30,59.94、および60フレーム/秒のフレームレートが可能ですが、25および50では使用できません。

アナログ衛星伝送のための変調

衛星電力はひどく制限されているため、衛星によるアナログビデオ伝送は地上波TV伝送とは異なります。 AMは線形変調方式なので、所与の復調された信号対雑音比(SNR)は、同等に高い受信RF SNRを必要とします。 スタジオ品質のビデオのSNRは50dBを超えているため、AMは非常に高い電力および/または大きなアンテナを必要とします。

代わりに広帯域FMを使用してRF帯域幅を削減し、電力を削減します。 チャネル帯域幅を6MHzから36MHzに増加させると、RF SNRはわずか10dB以下になります。 広帯域のノイズ帯域幅により、36dB / 6MHz = 8dBのこの40dBの省電力が大幅に削減され、32dBの実質的な低減が実現します。

地上波伝送の場合のようにFM副搬送波上に音があるが、4.5MHzを超える周波数は聴覚/視覚妨害を低減するために使用される。 6.8,5.8および6.2MHzが一般的に使用される。 ステレオは、多重、離散、またはマトリクスとすることができ、無関係なオーディオ信号およびデータ信号を追加の副搬送波上に配置することができる。

三角波60Hzのエネルギー分散波形が、変調前の複合ベースバンド信号(ビデオ+オーディオおよびデータ副搬送波)に加えられる。 これは、ビデオ信号が失われた場合の衛星のダウンリンク電力スペクトル密度を制限する。 さもなければ、衛星は、同じ周波数帯の地上波マイクロ波リンクを妨害する単一の周波数でその電力の全てを送信することができる。

ハーフトランスポンダモードでは、複合ベースバンド信号の周波数偏差が18MHzに低減され、36MHzトランスポンダの他の半分に別の信号を許容する。 これは、衛星トランスポンダの相互変調ひずみを避けるために、結合された信号電力が「バックオフ」されなければならないので、FM利益を多少減少させ、回復されたSNRをさらに減少させる。 単一のFM信号は一定の振幅であるため、歪みのないトランスポンダを飽和させることができます。

フィールドオーダー

NTSCの「フレーム」は、「偶数」フィールドの後に「奇数」フィールドが続きます。 アナログ信号の受信に関する限り、これはまったく従来の問題であり、違いはありません。 それは道路の真ん中を走っている破線のようなものですが、ライン/スペースペアかスペース/ラインペアかは関係ありません。 運転者への影響はまったく同じです。

デジタルテレビの導入により、状況は多少変化しました。 ほとんどのデジタルTVフォーマットは、1つのデジタルフレームとしてフィールドをペアで格納および送信します。 一般的なDVDフォーマットを含むNTSCフィールドレートに一致するデジタルフォーマットは、最初に偶数フィールドでデジタルフレームにビデオを記録し、625ラインシステムのフィールドレートに一致するフォーマットは、奇数フレームでビデオを記録することが多い。 これは、多くの非NTSCベースのデジタルフォーマットを再現する場合、フィールドオーダーを逆にする必要があることを意味します。そうでなければ、動いているオブジェクトが1つのフィールドの前に表示され、次のフィールドにジャンプするときに、

これはまた、非NTSCプログレッシブビデオがインタレースにトランスコードされるか、またはその逆の場合に危険になる。 プログレッシブフレームを復元するか、ビデオをトランスコードするシステムでは、「フィールドオーダー」に従っている必要があります。そうしないと、復元されたフレームは、1つのフレームのフィールドと隣接フレームのフィールドで構成されます。 これは、デインターレーシングアルゴリズムの不適切な選択が行われた場合、PCベースのビデオ再生ユーティリティでしばしば観察される。

米国の高出力NTSC放送では、2つのカメラの視野を切り替えることが2つの基準に基づいて行われました.2つの標準の選択は、地理学、東西で行われました。 1つの領域では、1フレームを終了した奇数フィールドと次のフレームを開始した偶数フィールドとの間で切り替えが行われた。 他方では、スイッチは偶数フィールドの後、奇数フィールドの前に作られた。 したがって、例えば、一時停止したときに、東部で地方テレビ局のテレビで録画された家庭用VHS録画は、(ディゾルブまたは他のマルチカメラ撮影が意図されていない限り)ロサンゼルスで録画され、編集され、その後、全国に送信されると、発信ショットを描く線の半分と入ってくるショットを描いた残りの半分のカメラとの間で切り替わる瞬間に一時停止することができる。