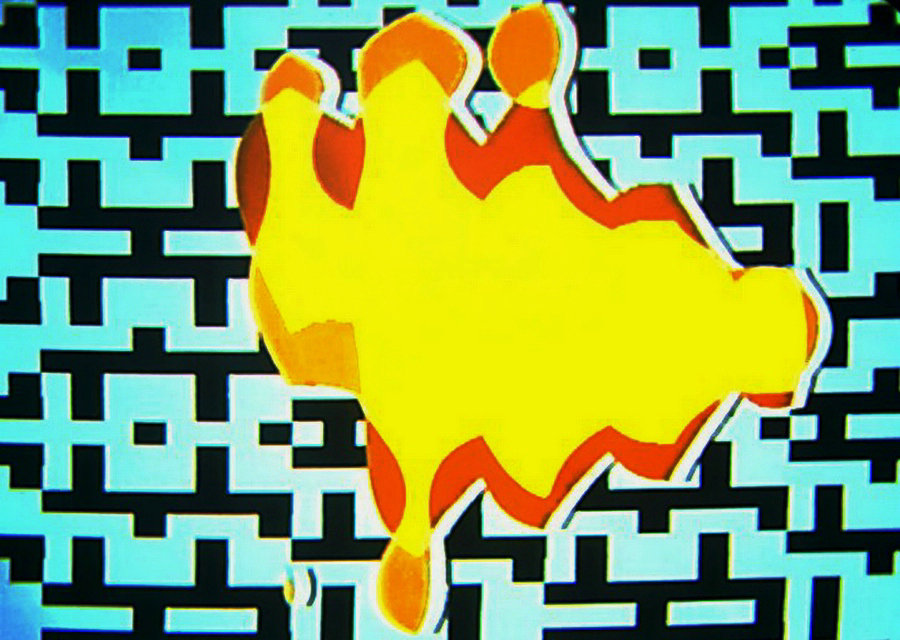

Un sintetizzatore video è un dispositivo che crea elettronicamente un segnale video. Un sintetizzatore video è in grado di generare una varietà di materiale visivo senza input della telecamera attraverso l’uso di generatori di pattern video interni. Può anche accettare e “ripulire e migliorare” o “distorcere” le immagini della telecamera televisiva in diretta. Il sintetizzatore crea una vasta gamma di immagini attraverso manipolazioni puramente elettroniche. Questa immagine è visibile all’interno del segnale video in uscita quando questo segnale viene visualizzato. Il segnale video in uscita può essere visualizzato su una vasta gamma di apparecchiature video convenzionali, come monitor TV, proiettori video teatrali, schermi di computer, ecc.

Non è necessario alcun computer o fotocamera per la generazione stessa, il segnale viene emesso interamente da zero e il segnale di uscita è spesso analogico. Pertanto, il supporto su cui è possibile visualizzare l’immagine è limitato. Gli schermi o i proiettori CRT vengono generalmente utilizzati perché il segnale video viene modificato in modo tale da essere valutato da un dispositivo digitale standard come danneggiato e non visualizza nulla.

Non è raro che alcuni sintetizzatori video vengano creati modificando i vecchi processori video utilizzati per pulire i video analogici. Questa conversione comporta la cosiddetta flessione del circuito, in cui i circuiti del dispositivo stesso vengono modificati, ad esempio aggiungendo un interruttore tra circuiti di circuito precedentemente divisi. Altre modifiche possono essere l’aggiunta di potenziometri o fotoresistori.

I generatori di pattern video possono produrre immagini statiche o in movimento o in evoluzione. Gli esempi includono motivi geometrici (in 2D o 3D), caratteri di testo dei sottotitoli in un tipo di carattere particolare o mappe meteorologiche.

Le immagini delle telecamere TV possono essere modificate a colori o ridimensionate geometricamente, inclinate, avvolte attorno ad oggetti e manipolate in altro modo.

Un particolare sintetizzatore video offrirà un sottoinsieme di possibili effetti.

La sintesi video può anche essere considerata come la modifica di un segnale audio ai fini della proiezione su un oscilloscopio, che, ad esempio, è stato utilizzato da Jerobeam Fenderson nel suo progetto Oscilloscope Music. Il segnale video (o le sue sottocartelle) può spesso essere modulato da un segnale audio, che insieme alla possibilità di lavorare in tempo reale ha trovato la sua applicazione in VJing in club, concerti o altre esibizioni.

Sintetizzatori video come strumenti di performance in tempo reale

La storia della sintesi video è legata a un’etica della “performance in tempo reale”. Normalmente si prevede che l’apparecchiatura funzioni sui segnali della telecamera di ingresso che la macchina non ha mai visto prima, fornendo un segnale elaborato in modo continuo e con un minimo di ritardo in risposta agli input video in diretta in continua evoluzione. Seguendo la tradizione degli strumenti di esecuzione del mondo della sintesi audio come Theremin, i sintetizzatori video sono stati progettati con l’aspettativa che sarebbero stati riprodotti in situazioni teatrali da concerto dal vivo o allestiti in uno studio pronto a elaborare una videocassetta da un videoregistratore in riproduzione reale tempo durante la registrazione dei risultati su un secondo videoregistratore. I luoghi di queste esibizioni includevano “Electronic Visualization Events” a Chicago, The Kitchen a New York e installazioni museali. L’artista / interprete video Don Slepian ha progettato, costruito ed eseguito uno strumento visivo controllato dal piede al Centre Pompidou di Parigi (1983) e al NY Open Center che combinava i primi micro-computer Apple II Plus genlock con il sintetizzatore video Chromaton 14. e canali di feedback video colorato.

Sintetizzatori digitali analogici e precoci in tempo reale esistevano prima della moderna modellazione 3D del computer. I rendering 3D tipici non sono in tempo reale, poiché si concentrano sul calcolo di ciascun fotogramma da, ad esempio, un algoritmo ricorsivo di ray tracing, per quanto tempo impieghi. Ciò li distingue dai sintetizzatori video, che devono fornire un nuovo frame di output al momento in cui è stato mostrato l’ultimo, e ripetere continuamente questa performance (in genere fornendo un nuovo frame regolarmente ogni 1/60 o 1/50 di secondo). Il vincolo in tempo reale si traduce in una differenza nella filosofia di progettazione tra queste due classi di sistemi.

I sintetizzatori video si sovrappongono con apparecchiature per effetti speciali video utilizzate in situazioni di trasmissione televisiva in rete in tempo reale e situazioni di post-produzione. Molte innovazioni nelle apparecchiature di trasmissione televisiva e nei display di computer grafica si sono evolute da sintetizzatori sviluppati nella comunità degli artisti di video e queste industrie spesso supportano “progetti di arte elettronica” in quest’area per mostrare apprezzamento di questa storia.

Confluenza di idee di elettronica e arte

Molti principi utilizzati nella costruzione dei primi sintetizzatori video riflettono un’interazione sana e dinamica tra i requisiti elettronici e le interpretazioni tradizionali delle forme artistiche. Ad esempio, Rutt & Etra e Sandin hanno portato avanti come un principio essenziale idee di Robert Moog che standardizzavano le gamme di segnali in modo che l’uscita di qualsiasi modulo potesse essere collegata al “controllo di tensione” di qualsiasi altro modulo. La conseguenza di ciò in una macchina come la Rutt-Etra fu che posizione, luminosità e colore erano completamente intercambiabili e potevano essere usati per modulare l’un l’altro durante l’elaborazione che portava all’immagine finale. Le videocassette di Louise e Bill Etra e Steina e Woody Vasulka hanno drammatizzato questa nuova classe di effetti.

EMS Spectron

Nel Regno Unito Richard Monkhouse, che lavora per Electronic Music Studios (London) Limited (EMS), ha sviluppato un sintetizzatore video ibrido – Spectre – in seguito ribattezzato “Spectron” che ha utilizzato il sistema di patchboard EMS per consentire connessioni completamente flessibili tra ingressi e uscite del modulo. I segnali video erano digitali, ma erano controllati da tensioni analogiche. C’era un patchboard digitale per la composizione delle immagini e un patchboard analogico per il controllo del movimento.

Evoluzione in frame buffer

I sintetizzatori video sono passati dall’analogico al controllo di precisione del digitale. I primi effetti digitali, come esemplificato da Video Weavings di Stephen Beck, utilizzavano oscillatori digitali opzionalmente collegati a reset orizzontali, verticali o frame per generare rampe di temporizzazione. Queste rampe potevano essere bloccate per creare l’immagine video stessa ed erano responsabili della sua struttura geometrica sottostante. Schier e Vasulka hanno avanzato lo stato dell’arte dai contatori di indirizzi ai generatori di indirizzi programmabili (microcodificabili) AMD Am2901 basati su slice. Sul percorso dei dati, hanno utilizzato unità aritmetiche e logiche 74S181, precedentemente pensate come un componente per eseguire istruzioni aritmetiche nei minicomputer, per elaborare segnali video in tempo reale, creando nuovi segnali che rappresentano la somma, la differenza, AND, XOR e così via, di due segnali di ingresso. Questi due elementi, il generatore di indirizzi,

Il generatore di indirizzi ha fornito gli indirizzi di lettura e scrittura a una memoria video in tempo reale, che può essere considerata un’evoluzione nella forma più flessibile di collegare i bit di indirizzo per produrre il video. Mentre il buffer di frame video è ora presente nella scheda grafica di ogni computer, non ha portato avanti alcune funzionalità dei primi sintetizzatori video. Il generatore di indirizzi conta in un modello rettangolare fisso dall’angolo in alto a sinistra dello schermo, attraverso ogni linea, fino in fondo. Ciò ha scartato un’intera tecnologia di modifica dell’immagine mediante variazioni nella sequenza di indirizzamento di lettura e scrittura fornita dai generatori di indirizzi hardware mentre l’immagine passava attraverso la memoria. Oggi, le distorsioni basate sull’indirizzo sono più spesso realizzate da operazioni blitter che spostano i dati nella memoria,

Storia di sintetizzatori video, designer e artisti

1960

1962, ANIMAC di Lee Harrison III: (computer di animazione grafica ibrida) – predecessore di Scanimate

1966, vsynths personalizzati di Dan Slater: Dan Slater ha costruito una serie di vsynths homebrew personalizzati nel corso degli anni e ha lavorato con Douglas Trumbull in vari film.

1968, PCS di Eric Siegel (Processing Chrominance Synthesizer)

1968, Computer Image Corporation Scanimate:

Video di un rapporto di notizie su Scanimate, inclusa l’intervista con l’inventore Lee Harrison III

1969, sintetizzatore Paik / Abe

Costruito nel WGBH Boston Experimental TV Center, progettato da Nam June Paik, progettato dall’artista / ingegnere Shuya Abe.

Molti costruiti presso la CalArts e il Experimental TV Center della Binghamton University, WNET NYC, Jim Wiseman ne ha ancora uno operativo

Fai clic sull’intestazione per una pagina dedicata, con ampie clip video reali

1969, VIDIUM di Bill Hearn: (driver / sequencer XYZ analogici)

1969, CVI Quantizer e CVI Data Camera di Glen Southworth

1970-1974

1970, Sintetizzatore video elettronico EVS di Eric Siegel e doppio coloratore (analogico)

1970, groove e VAmpire

(Operazioni di output in tempo reale generate su apparecchiature a tensione controllata)

(Programma video e musicale per esplorazione / sperimentazione interattiva in tempo reale).

1970, vsynth di Lear Siegler: esclusivo processore video Hi-Rez utilizzato nel film “Andromeda Strain” e da Douglas Trumbull e Dan Slater

Sintetizzatore video diretto di Stephen Beck e Weaver Video Beck

Stephen Beck ha creato alcuni sintetizzatori dei primi anni ’70 che non avevano input video. Hanno realizzato video esclusivamente da oscillazioni.

Ha anche modificato alcune unità Paik / Abe.

Sherman WALTER WRIGHT: Uno dei primi animatori di video, ha lavorato presso Computer Image Corp nei primi anni ’70, e successivamente in Dolphin Productions, dove ha gestito uno Scanimate. Mentre era al Dolphin, Ed Emshwiller e lui lavoravano insieme su Thermogenisis e Scapemates, e ha anche realizzato diversi nastri da solo. Nel 1973-76, come artista residente presso il Experimental Television Center di New York, ha aperto la strada alla performance video in tournée in centri di accesso pubblico, college e gallerie con il sintetizzatore video Paik / Abe. Ha anche lavorato con il coloratore David Jones e i moduli di sequenziamento Rich Brewsters. Questi vari moduli erano basati sul design di David per amplificatori video a controllo di tensione e sono diventati la base per lo studio ETC. Era lì quando Don McArthur costruì il SAID. Woody Vasulka e Jeff Schier erano a portata di mano nella costruzione di moduli basati su computer a Buffalo, tra cui un frame buffer con ALU integrati, mixer, keyer e coloranti. Wright ha anche lavorato con Gary Hill presso Woodstock Community Video, dove hanno tenuto uno spettacolo settimanale di sintesi video / audio dal vivo. Wright ha sviluppato il suo sistema video ad alte prestazioni, il Video Shredder, e lo utilizza per ipnotizzare il pubblico ovunque e ogni volta che può. Sta diventando abbastanza bravo. La sua missione è quella di creare una nuova musica di suoni e immagini. Si è esibito in tutta la costa orientale degli Stati Uniti e del Canada in gallerie d’arte e musei, scuole e college, media center, conferenze e festival. dove hanno avuto uno spettacolo via cavo settimanale di sintesi audio / video dal vivo. Wright ha sviluppato il suo sistema video ad alte prestazioni, il Video Shredder, e lo utilizza per ipnotizzare il pubblico ovunque e ogni volta che può. Sta diventando abbastanza bravo. La sua missione è quella di creare una nuova musica di suoni e immagini. Si è esibito in tutta la costa orientale degli Stati Uniti e del Canada in gallerie d’arte e musei, scuole e college, media center, conferenze e festival. dove hanno avuto uno spettacolo via cavo settimanale di sintesi audio / video dal vivo. Wright ha sviluppato il suo sistema video ad alte prestazioni, il Video Shredder, e lo utilizza per ipnotizzare il pubblico ovunque e ogni volta che può. Sta diventando abbastanza bravo. La sua missione è quella di creare una nuova musica di suoni e immagini. Si è esibito in tutta la costa orientale degli Stati Uniti e del Canada in gallerie d’arte e musei, scuole e college, media center, conferenze e festival.

1971, Sandin Image Processor: Sintetizzatore video molto antico …. Modulare fai-da-te, costruito da Dan Sandin di Chicago.

1972, Sintetizzatore video Rutt / Etra: co-inventato da Steve Rutt & Bill Etra, questo è un computer analogico per la manipolazione di video raster.

1973, Phil Morton pubblica “Note sull’estetica della copia di un elaboratore di immagini”. “Si è orgogliosamente definito se stesso come la” prima copiatrice “del processore di immagini Sandin. Il processore di immagini Sandin ha offerto agli artisti capacità senza precedenti di creare, elaborare e influenzare video e audio in tempo reale, consentendo performance che hanno letteralmente posto le basi per l’attuale audio-video in tempo reale Nuovo Media Art. ”

1974, VSYNTH di David Jones: molte creazioni, la più famosa è la Jones Colorizer, un colorizer a quattro canali controllabile in tensione con keyer di livello di grigio.

1974, EMS Spectre: sintetizzatore video innovativo che utilizza tecniche analogiche e digitali, sviluppato da Richard Monkhouse presso EMS. Successivamente ribattezzato “Spectron”.

1975-1979

1975, Dave Jones Video Digitizer: un primo processore video digitale utilizzato per la videoarte. Ha digitalizzato in tempo reale (senza clock di campionamento) e ha usato un ALU a 4 bit per creare effetti di colore

1975, SAID di Don McArthur: Don McArthur sviluppa il SAID (Spatial and Intensity Digitizer), una crescita della ricerca su un correttore della base dei tempi in bianco e nero con Dave Jones

1976, vsynth di Denise Gallant: Crea un sintetizzatore video analogico molto avanzato alla fine degli anni ’70.

1976, Chromaton 14

Un sintetizzatore video analogico abbastanza piccolo, con quantizzatori di colore e in grado di generare immagini a colori complesse senza input esterni.

Costruito da BJA Systems

1977, Jones Frame Buffer: Archiviazione digitale a bassa risoluzione di segnali video (versioni ad alta risoluzione e versioni multi-frame sono state realizzate nel 1979 e nei primi anni ’80)

1979, Chromachron: uno dei primi VSynths DIGITALI. – Progettato da Ed Tannenbaum.

1979, Chromascope Video Synthesizer, versioni PAL e NTSC. Creato da Robin Palmer. Prodotto da Chromatronics, Essex, Regno Unito. Distribuzione di CEL Electronics. Modello P135 (2.000 unità costruite) e Modello C.101 (100 unità costruite).

1980

1984, Fairlight CVI Computer Video Instrument: Il Fairlight CVI è stato prodotto nei primi anni ’80 ed è un processore video analogico digitale ibrido.

2000

Nel 2008, Lars Larsen e Ed Leckie hanno fondato LZX Industries e hanno iniziato a sviluppare nuovi moduli di sintetizzatore video analogico (serie Visionary, Cadet e Expedition).

2011, Critter & Guitari Video Scope: sintetizzatore video preimpostato.

2013, Critter & Guitari Rhythm Scope: sintetizzatore video predefinito.

2014, Critter & Guitari Black & White Video Scope: sintetizzatore video preimpostato.

2014, Ming Mecca: sintetizzatore video analogico orientato alla pixel art

2016, Paracosm Lumen: sintetizzatore video software semi-modulare per MacOS.

2016, Vsynth: un pacchetto di sintetizzatore video software modulare per Max / Jitter.

2016, Ming Micro: sintetizzatore video digitale orientato ai pixel art

2017, Critter & Guitari ETC: sintetizzatore video che supporta output a 720p.