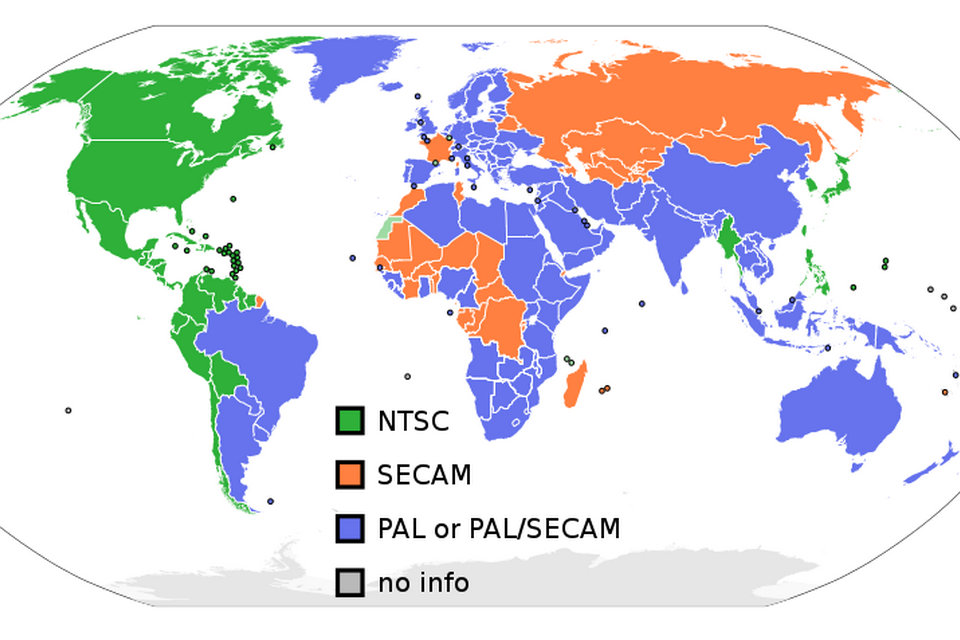

NTSC, che prende il nome dal National Television System Committee, è il sistema televisivo analogico utilizzato in Nord America e fino alla conversione digitale nella maggior parte delle Americhe (eccetto Brasile, Argentina, Paraguay, Uruguay e Guiana francese); Myanmar; Corea del Sud; Taiwan; Filippine, Giappone; e alcune nazioni e territori delle isole del Pacifico.

Il primo standard NTSC fu sviluppato nel 1941 e non prevedeva il colore. Nel 1953 fu adottato un secondo standard NTSC, che consentiva la trasmissione televisiva a colori compatibile con lo stock esistente di ricevitori in bianco e nero. NTSC è stato il primo sistema di trasmissione a colori ampiamente adottato ed è rimasto dominante fino agli anni 2000, quando ha iniziato a essere sostituito da diversi standard digitali come ATSC e altri.

La maggior parte dei paesi che utilizzano lo standard NTSC, così come quelli che utilizzano altri standard televisivi analogici, sono passati a, o sono in procinto di passare a nuovi standard di televisione digitale, ci sono almeno quattro diversi standard in uso in tutto il mondo. Il Nord America, alcune parti dell’America centrale e la Corea del Sud stanno adottando o hanno adottato gli standard ATSC, mentre altri paesi (come il Giappone) stanno adottando o hanno adottato altri standard invece di ATSC. Dopo quasi 70 anni, la maggior parte delle trasmissioni NTSC over-the-air negli Stati Uniti sono cessate il 1 ° gennaio 2010 e entro il 31 agosto 2011 in Canada e nella maggior parte dei mercati NTSC. La maggior parte delle trasmissioni NTSC è terminata in Giappone il 24 luglio 2011, con le prefetture giapponesi di Iwate, Miyagi e Fukushima che terminavano l’anno successivo. Dopo un programma pilota nel 2013, la maggior parte delle stazioni analogiche a piena potenza in Messico ha lasciato il via in dieci date nel 2015, con circa 500 stazioni a bassa potenza e ripetitori che hanno potuto rimanere in analogico fino alla fine del 2016. Le trasmissioni digitali consentono una maggiore risoluzione televisione, ma la televisione a definizione standard digitale continua a utilizzare il frame rate e il numero di linee di risoluzione stabilite dallo standard NTSC analogico.

Storia

Il comitato del sistema televisivo nazionale è stato istituito nel 1940 dalla Federal Communications Commission (FCC) degli Stati Uniti per risolvere i conflitti tra le società in merito all’introduzione di un sistema televisivo analogico nazionale negli Stati Uniti. Nel marzo del 1941, il comitato emanò uno standard tecnico per la televisione in bianco e nero basato su una raccomandazione del 1936 fatta dalla Radio Manufacturers Association (RMA). I progressi tecnici della tecnica della banda laterale rudimentale hanno permesso di aumentare la risoluzione dell’immagine. NTSC ha selezionato 525 linee di scansione come compromesso tra lo standard di linea di scansione 441 di RCA e il desiderio di Philco’s e DuMont di aumentare il numero di linee di scansione tra 605 e 800. Lo standard raccomandava una frequenza di fotogrammi di 30 fotogrammi al secondo, costituita di due campi interlacciati per frame a 262,5 linee per campo e 60 campi per secondo. Altri standard nella raccomandazione finale erano un rapporto di aspetto di 4: 3 e la modulazione di frequenza (FM) per il segnale sonoro (che era abbastanza nuovo al momento).

Nel gennaio 1950, il comitato fu ricostituito per standardizzare la televisione a colori. La FCC aveva brevemente approvato uno standard televisivo a colori nell’ottobre del 1950, sviluppato dalla CBS. Il sistema CBS non è compatibile con i ricevitori in bianco e nero esistenti. Utilizza una ruota cromatica rotante, riduce il numero di linee di scansione da 525 a 405 e aumenta la velocità di campo da 60 a 144, ma ha una frequenza di fotogrammi effettiva di soli 24 fotogrammi al secondo. L’azione legale della rivale RCA ha impedito l’uso commerciale del sistema fino al giugno del 1951 e le trasmissioni regolari sono durate solo pochi mesi prima che la produzione di tutti i televisori a colori fosse bandita dall’Official of Defense Mobilization in ottobre, apparentemente a causa della guerra coreana . La CBS rescinde il suo sistema nel marzo 1953 e la FCC lo sostituisce il 17 dicembre 1953 con lo standard di colore NTSC, che è stato sviluppato in cooperazione da diverse società, tra cui RCA e Philco.

Nel dicembre del 1953 la FCC approvò all’unanimità quello che oggi viene definito lo standard televisivo a colori NTSC (in seguito definito come RS-170a). Lo standard di colore compatibile mantiene la piena compatibilità con i precedenti televisori in bianco e nero. Le informazioni sul colore sono state aggiunte all’immagine in bianco e nero introducendo una sottoportante a colori di esattamente 315/88 MHz (generalmente descritta come 3.579545 MHz o 3.58 MHz). La frequenza precisa è stata scelta in modo che le componenti di modulazione della linea orizzontale del segnale di crominanza cadessero esattamente tra le componenti di modulazione della linea orizzontale del segnale di luminanza, consentendo così di filtrare il segnale di crominanza dal segnale di luminanza con una minore degradazione di il segnale di luminanza. A causa delle limitazioni dei circuiti divisori di frequenza nel momento in cui è stato promulgato lo standard di colore, la frequenza della sottoportante di colore è stata costruita come frequenza composita assemblata da piccoli numeri interi, in questo caso 5 × 7 × 9 / (8 × 11) MHz. La velocità della linea orizzontale è stata ridotta a circa 15.734 linee al secondo (3.579545 × 2/455 MHz = 9/572 MHz) da 15.750 linee al secondo e il frame rate è stato ridotto a 30 / 1.001 ≈ 29.970 frame al secondo (la linea orizzontale tasso diviso per 525 linee / fotogramma) da 30 fotogrammi al secondo. Questi cambiamenti ammontano allo 0,1% e sono stati prontamente tollerati dai ricevitori televisivi esistenti.

La prima trasmissione televisiva di rete pubblicamente annunciata di un programma che utilizzava il sistema “compatibile con il colore” NTSC era un episodio della NBC Kukla, Fran e Ollie il 30 agosto 1953, sebbene fosse visibile a colori solo nella sede centrale della rete. La prima visione a livello nazionale del colore NTSC è arrivata il 1 ° gennaio successivo con la trasmissione coast-to-coast della Tournament of Roses Parade, visibile su ricevitori di colori prototipo in occasione di presentazioni speciali in tutto il paese. La prima telecamera televisiva NTSC a colori fu la RCA TK-40, utilizzata per trasmissioni sperimentali nel 1953; una versione migliorata, la TK-40A, introdotta nel marzo del 1954, fu la prima telecamera a colori disponibile in commercio. Più tardi quell’anno, il TK-41 migliorato divenne la fotocamera standard utilizzata per gran parte degli anni ’60.

Lo standard NTSC è stato adottato da altri paesi, inclusa la maggior parte delle Americhe e del Giappone.

Con l’avvento della televisione digitale, le trasmissioni analogiche vengono gradualmente eliminate.La maggior parte delle emittenti americane NTSC è stata obbligata dalla FCC a chiudere i propri trasmettitori analogici nel 2009. Le stazioni a bassa potenza, le stazioni di classe A ei traduttori sono stati costretti a chiudere entro il 2015.

Dettagli tecnici

Linee e frequenza di aggiornamento

La codifica a colori NTSC viene utilizzata con il segnale televisivo System M, che consiste in 30/1.001 (circa 29,97) fotogrammi interlacciati di video al secondo. Ogni frame è composto da due campi, ciascuno composto da 262.5 linee di scansione, per un totale di 525 linee di scansione. 483 linee di scansione compongono il raster visibile. Il resto (l’intervallo di blanking verticale) consente la sincronizzazione e il ritracciamento verticale. Questo intervallo di cancellazione era originariamente progettato per disattivare semplicemente il CRT del ricevitore per consentire i semplici circuiti analogici e il lento ritracciamento verticale dei primi ricevitori TV. Tuttavia, alcune di queste linee possono ora contenere altri dati come sottotitoli e timecode di intervallo verticale (VITC). Nel raster completo (ignorando le mezzitoni dovute all’intreccio) le linee di scansione pari (tutte le altre linee che sarebbero anche se contate nel segnale video, ad esempio {2, 4, 6, …, 524}) sono disegnate nel primo campo, e il numero dispari (ogni altra riga che sarebbe dispari se contata nel segnale video, ad esempio {1, 3, 5, …, 525}) sono disegnate nel secondo campo, per produrre un immagine sfarfallio al campo frequenza di aggiornamento di 60/1.001 Hz (circa 59.94 Hz). Per confronto, i sistemi 576i come PAL-B / G e SECAM usano 625 linee (576 visibili), e quindi hanno una risoluzione verticale più elevata, ma una risoluzione temporale inferiore di 25 fotogrammi o 50 campi al secondo.

La frequenza di aggiornamento del campo NTSC nel sistema in bianco e nero originariamente corrispondeva esattamente alla frequenza nominale di 60 Hz della corrente alternata utilizzata negli Stati Uniti. Corrispondenza della frequenza di aggiornamento del campo all’intermodulazione evitata dalla fonte di alimentazione (chiamata anche battitura), che produce barre di laminazione sullo schermo. La sincronizzazione della frequenza di aggiornamento alla potenza ha aiutato incidentalmente le telecamere del cinescopio a registrare le prime trasmissioni televisive dal vivo, poiché era molto semplice sincronizzare una telecamera per catturare un fotogramma di video su ciascun fotogramma usando la frequenza corrente alternata per impostare la velocità del videocamera sincrona con motore elettrico. Quando il colore è stato aggiunto al sistema, la frequenza di aggiornamento è stata spostata leggermente verso il basso dallo 0,1% a circa 59,94 Hz per eliminare i pattern punto stazionari nella frequenza di differenza tra i supporti audio e colore, come spiegato di seguito in “Color encoding”. Nel momento in cui la frequenza fotogrammi è cambiata per adattarsi al colore, è stato quasi altrettanto facile attivare l’otturatore della fotocamera dal segnale video stesso.

La cifra effettiva di 525 linee è stata scelta in conseguenza dei limiti delle tecnologie basate sulla valvola a vuoto del giorno. Nei primi sistemi TV, un oscillatore master controllato in tensione veniva eseguito al doppio della frequenza della linea orizzontale e questa frequenza era divisa per il numero di linee utilizzate (in questo caso 525) per fornire la frequenza del campo (60 Hz in questo caso) .Questa frequenza è stata quindi confrontata con la frequenza della linea di alimentazione a 60 Hz e qualsiasi discrepanza corretta regolando la frequenza dell’oscillatore master. Per la scansione interlacciata, era necessario un numero dispari di linee per fotogramma per rendere la distanza di ritraccia verticale identica per i campi pari e dispari, il che significava che la frequenza dell’oscillatore principale doveva essere divisa per un numero dispari. All’epoca, l’unico metodo pratico di divisione della frequenza era l’uso di una catena di multivibratori a valvole sottovuoto, il rapporto di divisione complessivo essendo il prodotto matematico dei rapporti di divisione della catena. Poiché tutti i fattori di un numero dispari devono anche essere numeri dispari, ne consegue che tutti i divisori della catena dovevano anche dividere per numeri dispari, e questi dovevano essere relativamente piccoli a causa dei problemi di deriva termica con i dispositivi a valvole a vuoto . La sequenza pratica più vicina a 500 che soddisfa questi criteri era 3 × 5 × 5 × 7 = 525. (Per lo stesso motivo, 625 linee PAL-B / G e SECAM utilizzano 5 × 5 × 5 × 5, il vecchio sistema britannico a 405 linee utilizzava 3 × 3 × 3 × 3 × 5, il sistema francese a 819 linee usato 3 × 3 × 7 × 13 ecc.)

colorimetria

La specifica NTSC a colori del 1953 originale, ancora parte del Codice dei regolamenti federali degli Stati Uniti, definiva i valori colorimetrici del sistema come segue:

| Colorimetria originale NTSC (1953) | CIE 1931 x | CIE 1931 y |

|---|---|---|

| rosso primario | 0.67 | 0,33 |

| verde primario | 0,21 | 0.71 |

| blu primario | 0.14 | 0,08 |

| punto bianco (CIE standard illuminante C) 6774 K | 0,310 | 0,316 |

I primi ricevitori televisivi a colori, come l’RCA CT-100, erano fedeli a questa specifica (basata sugli standard cinematografici prevalenti), con una gamma più ampia rispetto alla maggior parte dei monitor attuali. I loro fosfori a bassa efficienza (in particolare nel rosso) erano deboli e persistenti a lungo, lasciando tracce dopo aver spostato gli oggetti. A partire dalla fine degli anni ’50, i fosfori del tubo di immagine sacrificerebbero la saturazione per una maggiore luminosità; questa deviazione dallo standard sia nel ricevitore che nell’emittente era la fonte di notevoli variazioni di colore.

SMPTE C

Per garantire una riproduzione del colore più uniforme, i ricevitori hanno iniziato a incorporare circuiti di correzione del colore che convertivano il segnale ricevuto – codificato per i valori colorimetrici sopra elencati – in segnali codificati per i fosfori effettivamente utilizzati all’interno del monitor. Poiché tale correzione del colore non può essere eseguita con precisione sui segnali di correzione gamma non lineari trasmessi, la regolazione può essere solo approssimata, introducendo errori di tonalità e luminanza per colori altamente saturi.

Similmente allo stadio televisivo, nel 1968-69 la Conrac Corp., lavorando con RCA, definì una serie di fosfori controllati per l’uso nei monitor di immagini video a colori broadcast. Questa specifica sopravvive oggi come specifica del fosforo SMPTE “C”:

| Colorimetria SMPTE “C” | CIE 1931 x | CIE 1931 y |

|---|---|---|

| rosso primario | 0.630 | 0,340 |

| verde primario | 0,310 | 0,595 |

| blu primario | 0,155 | 0,070 |

| punto bianco (illuminante CIE D65) | 0,3127 | 0,3290 |

Come per i ricevitori domestici, è stato inoltre raccomandato che i monitor da studio incorporino circuiti di correzione del colore simili in modo che le emittenti trasmettessero immagini codificate per i valori colorimetrici originali del 1953, in conformità con gli standard FCC.

Nel 1987, il comitato per le tecnologie televisive della Society of Motion Picture and Television Engineers (SMPTE), Working Group su Studio Monitor Colorimetry, adottò i fosfori SMPTE C (Conrac) per uso generale in Recommended Practice 145, spingendo molti produttori a modificare i loro progetti di telecamere per codificare direttamente per la colorimetria SMPTE “C” senza correzione del colore, come approvato nello standard SMPTE 170M, “Segnale video analogico composito – NTSC per applicazioni Studio” (1994). Di conseguenza, lo standard della televisione digitale ATSC afferma che per i segnali 480i si deve assumere la colorimetria SMPTE “C” a meno che i dati colorimetrici non siano inclusi nel flusso di trasporto.

NTSC giapponese non ha mai cambiato primarie e whitepoint in SMPTE “C”, continuando a utilizzare i primari NTSC del 1953 e il punto di bianco. Entrambi i sistemi PAL e SECAM hanno utilizzato la colorimetria originale NTSC del 1953 fino al 1970; a differenza di NTSC, tuttavia, l’European Broadcasting Union (EBU) ha rifiutato la correzione del colore nei ricevitori e nei monitor da studio quell’anno e ha invece richiesto esplicitamente che tutte le apparecchiature codifichino direttamente i segnali per i valori colorimetrici “EBU”, migliorando ulteriormente la fedeltà cromatica di tali sistemi.

Codifica del colore

Per la retrocompatibilità con la televisione in bianco e nero, NTSC utilizza un sistema di codifica di luminanza-crominanza inventato nel 1938 da Georges Valensi. I tre segnali dell’immagine a colori sono divisi in Luminanza (derivata matematicamente dai tre segnali di colore separati (Rosso, Verde e Blu)) che sostituisce il segnale monocromatico originale e il Crominanza che trasporta solo le informazioni sul colore. Questo processo viene applicato a ciascuna fonte di colore tramite il proprio Colorplexer, consentendo così di gestire una fonte di colore compatibile come se fosse una normale fonte monocromatica. Ciò consente ai ricevitori in bianco e nero di visualizzare i segnali di colore NTSC semplicemente ignorando il segnale di crominanza. Alcuni televisori in bianco e nero venduti negli Stati Uniti dopo l’introduzione della trasmissione a colori nel 1953 sono stati progettati per filtrare la crominanza, ma i primi B & amp; W non lo hanno fatto e la crominanza potrebbe essere vista come un “punto a punto” in alta aree colorate dell’immagine.

In NTSC, la crominanza viene codificata utilizzando due segnali di colore noti come I (in fase) e Q (in quadratura) in un processo chiamato QAM. I due segnali modulano ciascuna ampiezza di portanti di 3,58 MHz che sono sfasati di 90 gradi l’uno con l’altro e il risultato sommato insieme ma con i vettori stessi viene soppresso. Il risultato può essere visto come una singola onda sinusoidale con fase variabile rispetto a un vettore di riferimento e con ampiezza variabile. La fase variabile rappresenta la tonalità di colore istantanea catturata da una telecamera TV e l’ampiezza rappresenta la saturazione del colore istantanea. Questa sottoportante a 3,58 MHz viene quindi aggiunta alla Luminanza per formare il ‘segnale di colore composito’ che modula la portante del segnale video proprio come nella trasmissione monocromatica.

Per una TV a colori per recuperare le informazioni sulla tonalità dalla sottoportante del colore, deve avere un riferimento di fase zero per sostituire la portante soppressa in precedenza. Il segnale NTSC include un breve campione di questo segnale di riferimento, noto come colorburst, situato sulla “veranda posteriore” di ciascun impulso di sincronizzazione orizzontale. Il burst del colore consiste in un minimo di otto cicli della sottoportante a colori non modulato (fase e ampiezza fissa). Il ricevitore TV ha un “oscillatore locale”, che è sincronizzato con queste raffiche di colore. La combinazione di questo segnale di fase di riferimento derivato dal burst del colore con l’ampiezza e la fase del segnale di crominanza consente il recupero dei segnali “I” e “Q” che, combinati con le informazioni sulla luminanza, consentono la ricostruzione di un’immagine a colori sullo schermo. La TV a colori è stata detta per essere TV colorata a causa della separazione totale della parte di luminosità dell’immagine dalla porzione di colore. Nei televisori CRT, il segnale NTSC viene trasformato in tre segnali di colore denominati Rosso, Verde e Blu, ciascuno dei quali controlla il cannone elettronico a colori. I televisori con circuiti digitali utilizzano tecniche di campionamento per elaborare i segnali, ma il risultato finale è lo stesso. Sia per i set analogici che digitali che elaborano un segnale NTSC analogico, i tre segnali di colore originali (Rosso, Verde e Blu) vengono trasmessi utilizzando tre segnali discreti (Luminanza, I e Q) e quindi recuperati come tre colori separati e combinati come immagine a colori .

Quando un trasmettitore trasmette un segnale NTSC, modula l’ampiezza di una portante in radiofrequenza con il segnale NTSC appena descritto, mentre modula in frequenza una portante di 4,5 MHz più alta con il segnale audio. Se si verifica una distorsione non lineare al segnale di trasmissione, la portante del colore 3.579.545 MHz può battere con la portante del suono per produrre un motivo a punti sullo schermo. Per rendere meno evidente il modello risultante, i progettisti hanno adattato la frequenza di scansione 15,750 Hz originale di un fattore di 1,001 (0,1%) per far corrispondere la frequenza della portante audio divisa per il fattore 286, risultando in una velocità di campo di circa 59,94 Hz. Questa regolazione garantisce che le somme e le differenze della portante del suono e della sottoportante del colore e i loro multipli (cioè i prodotti di intermodulazione dei due vettori) non siano multipli esatti della frequenza dei fotogrammi, che è la condizione necessaria perché i punti rimangano fermi sullo schermo, rendendoli più evidenti.

La velocità del 59,94 deriva dai seguenti calcoli. I progettisti hanno scelto di rendere la frequenza della sottoportante della crominanza un multiplo + 0,5 della frequenza di linea per minimizzare l’interferenza tra il segnale di luminanza e il segnale di crominanza. (Un altro modo viene spesso detto è che la frequenza della sottoportante colore è un multiplo dispari di metà della frequenza di linea.) Quindi hanno scelto di rendere la frequenza della sottoportante audio un multiplo intero della frequenza di linea per minimizzare l’interferenza visibile (intermodulazione) tra l’audio segnale e il segnale di crominanza. Lo standard originale in bianco e nero, con la sua frequenza di linea di 15,750 Hz e la sottoportante audio a 4,5 MHz, non soddisfa questi requisiti, quindi i progettisti hanno dovuto alzare la frequenza della sottoportante audio o abbassare la frequenza di linea. Aumentare la frequenza della sottoportante audio impedirebbe ai ricevitori esistenti (in bianco e nero) di sintonizzarsi correttamente nel segnale audio. L’abbassamento della frequenza di linea è relativamente innocuo, poiché le informazioni di sincronizzazione orizzontale e verticale nel segnale NTSC consentono a un ricevitore di tollerare una notevole quantità di variazione nella frequenza di linea. Quindi gli ingegneri hanno scelto la frequenza di linea da modificare per lo standard dei colori.Nello standard in bianco e nero, il rapporto tra frequenza della sottoportante audio e frequenza di linea è 4,5 MHz / 15,750 Hz = 285,71. Nello standard dei colori, questo viene arrotondato all’intero 286, il che significa che la velocità di linea dello standard di colore è 4,5 MHz/286 ≈ 15.734 Hz.Mantenendo lo stesso numero di linee di scansione per campo (e frame), la velocità di linea inferiore deve produrre una frequenza di campo inferiore. Dividere 4500000/286 linee al secondo di 262,5 linee per campo fornisce circa 59,94 campi al secondo.

Metodo di modulazione della trasmissione

Un canale televisivo NTSC trasmesso occupa una larghezza di banda totale di 6 MHz. Il segnale video effettivo, che è modulato in ampiezza, viene trasmesso tra 500 kHz e 5,45 MHz sopra il limite inferiore del canale. Il portante video è 1,25 MHz sopra il limite inferiore del canale. Come la maggior parte dei segnali AM, il supporto video genera due bande laterali, una sopra l’operatore e una sotto.Le bande laterali sono larghe 4,2 MHz. Viene trasmessa l’intera banda laterale superiore, ma viene trasmessa solo 1,25 MHz della banda laterale inferiore, nota come banda laterale rudimentale. La sottoportante di colore, come notato sopra, è 3.579545 MHz sopra la portante video ed è modulata in ampiezza in quadratura con una portante soppressa. Il segnale audio è modulato in frequenza, come i segnali audio trasmessi dalle stazioni radio FM nella banda 88-108 MHz, ma con una deviazione di frequenza massima di 25 kHz, rispetto a 75 kHz come viene utilizzato sulla banda FM, rendendo la televisione analogica i segnali audio sono più silenziosi dei segnali radio FM ricevuti su un ricevitore a larga banda. La portante audio principale è 4,5 MHz sopra la portante video, rendendola 250 kHz sotto la parte superiore del canale. A volte un canale può contenere un segnale MTS, che offre più di un segnale audio aggiungendo una o due sottoportanti sul segnale audio, ciascuna sincronizzata con un multiplo della frequenza di linea. Questo è normalmente il caso quando si usano segnali audio stereo e / o secondi del programma audio. Le stesse estensioni vengono utilizzate in ATSC, dove la portante digitale ATSC viene trasmessa a 0.31 MHz sopra il limite inferiore del canale.

“Setup” è un offset di tensione di 54 mV (7,5 IRE) tra i livelli “nero” e “blanking”. È unico per NTSC.CVBS è l’acronimo di Colore, Video, Blanking e Sincronizzazione.

Conversione del frame rate

Esiste una grande differenza nella frequenza dei fotogrammi tra pellicola, che gira a 24,0 fotogrammi al secondo, e lo standard NTSC, che funziona a circa 29,97 (10 MHz × 63/88/455/525) fotogrammi al secondo. Nelle regioni che utilizzano standard televisivi e video 25-fps, questa differenza può essere superata con l’accelerazione.

Per gli standard a 30 fps, viene utilizzato un processo chiamato “3: 2 pulldown”. Un fotogramma viene trasmesso per tre campi video (della durata di 1½ fotogrammi video) e il fotogramma successivo viene trasmesso per due campi video (della durata di 1 fotogramma video). Due fotogrammi vengono quindi trasmessi in cinque campi video, per una media di 2½ campi video per fotogramma. Il frame rate medio è quindi 60 ÷ 2.5 = 24 frame al secondo, quindi la velocità media del film è nominalmente esattamente come dovrebbe essere. (In realtà, nel corso di un’ora di tempo reale, vengono visualizzati 215.827.2 campi video, che rappresentano 86.330.88 fotogrammi di film, mentre in un’ora di proiezione di film a 24 fps, vengono visualizzati esattamente 86.400 fotogrammi: quindi, 29,97 fps NTSC la trasmissione del film a 24-fps funziona al 99,92% della velocità normale del film.) L’inquadratura fissa in riproduzione può visualizzare un fotogramma video con campi di due fotogrammi diversi, quindi qualsiasi differenza tra i fotogrammi apparirà come un rapido back-and- avanti sfarfallio. Ci possono anche essere notevoli oscillazioni / “balbuzie” durante le panoramiche lente della telecamera (telecine).

Per evitare il pulldown 3: 2, il film girato specificamente per la televisione NTSC viene spesso acquisito a 30 frame / s.

Per mostrare materiale a 25 fps (come serie televisive europee e alcuni film europei) su apparecchiature NTSC, ogni quinto fotogramma viene duplicato e quindi il flusso risultante viene interlacciato.

Il film girato per la televisione NTSC a 24 frame al secondo è stato tradizionalmente accelerato da 1/24 (a circa il 104.17% della velocità normale) per la trasmissione in regioni che utilizzano standard televisivi a 25-fps. Questo aumento della velocità dell’immagine è stato tradizionalmente accompagnato da un aumento simile del tono e del tempo dell’audio. Più recentemente, il frame-blending è stato utilizzato per convertire 24 video FPS in 25 FPS senza alterarne la velocità.

Le riprese per la televisione in regioni che utilizzano standard televisivi a 25-fps possono essere gestite in due modi:

Il film può essere girato a 24 fotogrammi al secondo. In questo caso, quando trasmesso nella sua regione nativa, il film può essere accelerato a 25 fps secondo la tecnica analogica sopra descritta, o mantenuto a 24 fps dalla tecnica digitale sopra descritta. Quando lo stesso film viene trasmesso in regioni che utilizzano uno standard televisivo nominale a 30 fps, non vi è alcun cambiamento evidente in termini di velocità, tempo e intonazione.

Il film può essere girato a 25 fotogrammi al secondo. In questo caso, quando viene trasmesso nella sua regione nativa, il film viene mostrato alla sua velocità normale, senza alterazione della relativa colonna sonora. Quando lo stesso film viene mostrato in regioni che utilizzano uno standard televisivo nominale a 30 fps, ogni quinto fotogramma viene duplicato e non vi sono ancora cambiamenti evidenti in velocità, tempo e intonazione.

Poiché entrambe le velocità del film sono state utilizzate nelle regioni a 25 fps, gli spettatori possono essere confusi circa la vera velocità del video e dell’audio e il tono delle voci, degli effetti sonori e delle esibizioni musicali nei film televisivi di quelle regioni. Ad esempio, potrebbero chiedersi se la serie di film di Sherlock Holmes di Jeremy Brett, realizzata negli anni ’80 e nei primi anni ’90, sia stata girata a 24 fps e poi trasmessa ad una velocità artificiale nelle regioni a 25-fps, o se sia stata girata a 25 fps in modo nativo e poi rallentati a 24 fps per la mostra NTSC.

Queste discrepanze esistono non solo nelle trasmissioni televisive via etere e via cavo, ma anche nel mercato home-video, sia su nastro che su disco, inclusi dischi laser e DVD.

Nella televisione digitale e nel video, che stanno sostituendo i loro predecessori analogici, gli standard singoli che possono ospitare una gamma più ampia di frame rate mostrano ancora i limiti degli standard regionali analogici. Lo standard ATSC, ad esempio, consente frame rate di 23.976, 24, 29.97, 30, 59.94 e 60 frame al secondo, ma non di 25 e 50.

Modulazione per trasmissione satellitare analogica

Poiché l’energia del satellite è fortemente limitata, la trasmissione video analogica attraverso i satelliti differisce dalla trasmissione televisiva terrestre. AM è un metodo di modulazione lineare, quindi un dato rapporto segnale / rumore demodulato (SNR) richiede un SNR RF ricevuto ugualmente alto. L’SNR del video di qualità da studio è superiore a 50 dB, quindi AM richiederebbe potenze proibitive e / o antenne di grandi dimensioni.

La banda larga FM viene invece utilizzata per scambiare la larghezza di banda RF per una potenza ridotta. L’aumento della larghezza di banda del canale da 6 a 36 MHz consente un SNR RF di soli 10 dB o meno. La larghezza di banda del rumore più ampia riduce questi 40 dB di risparmio energetico di 36 MHz / 6 MHz = 8 dB per una sostanziale riduzione netta di 32 dB.

Il suono si trova su una sottoportante FM come nella trasmissione terrestre, ma le frequenze superiori a 4,5 MHz vengono utilizzate per ridurre l’interferenza visiva / uditiva. 6.8, 5.8 e 6.2 MHz sono comunemente usati. Stereo può essere multiplex, discreto o matrice e segnali audio e dati non correlati possono essere posti su ulteriori subportatori.

Una forma d’onda triangolare di dispersione di energia a 60 Hz viene aggiunta al segnale composito in banda base (video più audio e subcarrier di dati) prima della modulazione. Questo limita la densità spettrale del downlink del satellite in caso di perdita del segnale video. Altrimenti il satellite potrebbe trasmettere tutta la sua potenza su una singola frequenza, interferendo con i collegamenti a microonde terrestri nella stessa banda di frequenza.

Nella modalità a mezzo transponder, la deviazione di frequenza del segnale in banda base composita viene ridotta a 18 MHz per consentire un altro segnale nell’altra metà del transponder a 36 MHz. Ciò riduce in qualche modo il beneficio FM e gli SNR recuperati vengono ulteriormente ridotti perché la potenza del segnale combinato deve essere “disattivata” per evitare la distorsione di intermodulazione nel transponder satellitare. Un singolo segnale FM ha un’ampiezza costante, quindi può saturare un transponder senza distorsioni.

Ordine dei campi

Un “frame” NTSC consiste in un campo “pari” seguito da un campo “dispari”. Per quanto riguarda la ricezione di un segnale analogico, questo è puramente una questione di convenzione e, non fa differenza. È piuttosto come le linee spezzate che scorrono nel mezzo di una strada, non importa se si tratta di una coppia linea / spazio o una coppia spazio / linea; l’effetto per un guidatore è esattamente lo stesso.

L’introduzione dei formati di televisione digitale ha cambiato le cose in qualche modo. La maggior parte dei formati TV digitali memorizza e trasmette i campi a coppie come una singola cornice digitale. I formati digitali che corrispondono alla frequenza di campo NTSC, incluso il popolare formato DVD, registrano video con il campo pari prima nel frame digitale, mentre i formati che corrispondono alla frequenza di campo del sistema 625 line spesso registrano video con frame dispari. Ciò significa che quando si riproducono molti formati digitali non basati su NTSC è necessario invertire l’ordine dei campi, altrimenti si verifica un inaccettabile effetto “pettinatore” tremolante sugli oggetti in movimento mentre vengono visualizzati in avanti in un campo e quindi saltano indietro nel successivo.

Questo è anche diventato un rischio in cui il video progressivo non NTSC viene transcodificato in interlacciato e viceversa. I sistemi che recuperano fotogrammi progressivi o transcodifica video dovrebbero garantire che l’ordine dei campi sia rispettato, altrimenti il fotogramma recuperato consisterà in un campo da un fotogramma e un campo da un fotogramma adiacente, risultante in artefatti di interlacciamento “a pettine”. Questo può essere spesso osservato nelle utilità di riproduzione video basate su PC se viene effettuata una scelta inappropriata dell’algoritmo di deinterlacciamento.

Durante i decenni di trasmissioni NTSC ad alta potenza negli Stati Uniti, il passaggio tra le viste da due telecamere è stato realizzato secondo due standard, la scelta tra i due è stata effettuata dalla geografia, Est contro Ovest. In una regione, l’interruttore è stato creato tra il campo dispari che ha completato un fotogramma e il campo pari che ha iniziato il fotogramma successivo; nell’altro, l’interruttore è stato realizzato dopo un campo pari e prima di un campo dispari. Così, ad esempio, una registrazione VHS di casa fatta da un telegiornale locale in Oriente, in pausa, mostrerebbe sempre la vista solo da una telecamera (a meno che non fosse previsto un dissolvenza o un altro scatto multicamera), mentre la riproduzione VHS di una situazione comica registrato e montato a Los Angeles e poi trasmesso a livello nazionale potrebbe essere messo in pausa al momento di un passaggio tra le telecamere con metà delle linee che raffigurano lo scatto in uscita e l’altra metà raffigurante il tiro in arrivo.