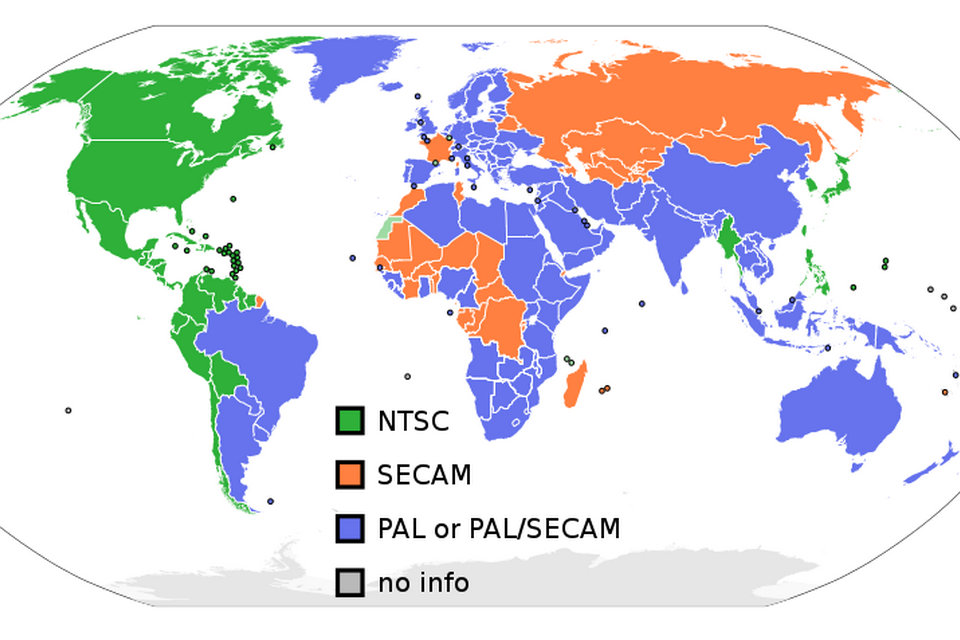

NTSC, llamado así por el Comité del Sistema Nacional de Televisión, es el sistema de televisión analógica que se usa en América del Norte, y hasta que se usó la conversión digital en la mayoría de las Américas (excepto Brasil, Argentina, Paraguay, Uruguay y Guayana Francesa); Myanmar; Corea del Sur; Taiwán; Filipinas, Japón; y algunas naciones y territorios insulares del Pacífico.

El primer estándar NTSC se desarrolló en 1941 y no tenía ninguna disposición para el color. En 1953 se adoptó un segundo estándar NTSC, que permitía la transmisión de televisión en color, que era compatible con el stock existente de receptores en blanco y negro. NTSC fue el primer sistema de difusión de color ampliamente adoptado y se mantuvo dominante hasta la década de 2000, cuando comenzó a ser reemplazado por diferentes estándares digitales como ATSC y otros.

La mayoría de los países que usan el estándar NTSC, así como aquellos que usan otros estándares de televisión analógica, han cambiado o están en proceso de cambiar a los estándares de televisión digital más nuevos, existiendo al menos cuatro estándares diferentes en uso en todo el mundo. América del Norte, partes de América Central y Corea del Sur están adoptando o han adoptado las normas ATSC, mientras que otros países (como Japón) están adoptando o han adoptado otras normas en lugar de ATSC. Después de casi 70 años, la mayoría de las transmisiones NTSC aéreas en los Estados Unidos cesaron el 1 de enero de 2010 y el 31 de agosto de 2011 en Canadá y la mayoría de los demás mercados NTSC. La mayoría de las transmisiones NTSC finalizaron en Japón el 24 de julio de 2011, y las prefecturas japonesas de Iwate, Miyagi y Fukushima finalizaron el año siguiente. Después de un programa piloto en 2013, la mayoría de las estaciones analógicas de máxima potencia en México salieron al aire en diez fechas en 2015, con unas 500 estaciones de baja potencia y repetidoras que pueden permanecer en analógico hasta el final de 2016. La transmisión digital permite una mayor resolución televisión, pero la televisión de definición estándar digital continúa utilizando la velocidad de fotogramas y el número de líneas de resolución establecidas por el estándar analógico NTSC.

Historia

El Comité del Sistema Nacional de Televisión fue establecido en 1940 por la Comisión Federal de Comunicaciones de los Estados Unidos (FCC) para resolver los conflictos que se produjeron entre las empresas con respecto a la introducción de un sistema nacional de televisión analógica en los Estados Unidos. En marzo de 1941, el comité emitió un estándar técnico para la televisión en blanco y negro que se basaba en una recomendación hecha en 1936 por la Asociación de Fabricantes de Radio (RMA). Los avances técnicos de la técnica de bandas laterales vestigiales permitieron la oportunidad de aumentar la resolución de la imagen. El NTSC seleccionó 525 líneas de escaneo como un compromiso entre el estándar de escaneo 441 de RCA y el deseo de Philco y DuMont de aumentar el número de líneas de escaneo a entre 605 y 800. El estándar recomienda una velocidad de cuadro de 30 cuadros por segundo, que consiste en de dos campos entrelazados por marco a 262.5 líneas por campo y 60 campos por segundo. Otros estándares en la recomendación final fueron una relación de aspecto de 4: 3 y modulación de frecuencia (FM) para la señal de sonido (que era bastante nueva en ese momento).

En enero de 1950, el comité fue reconstituido para estandarizar la televisión en color. La FCC había aprobado brevemente un estándar de televisión en color en octubre de 1950, que fue desarrollado por CBS. El sistema CBS es incompatible con los receptores en blanco y negro existentes. Utiliza una rueda de color giratoria, reduce el número de líneas de escaneo de 525 a 405 y aumenta la frecuencia de campo de 60 a 144, pero tiene una velocidad de cuadros efectiva de solo 24 fotogramas por segundo. Las acciones legales de RCA mantuvieron el uso comercial del sistema fuera del aire hasta junio de 1951, y las transmisiones regulares solo duraron unos meses antes de que la Oficina de Defensa Movilizara la fabricación de todos los televisores en color en octubre, aparentemente debido a la Guerra de Corea. . CBS rescindió su sistema en marzo de 1953, y la FCC lo reemplazó el 17 de diciembre de 1953 con el estándar de color NTSC, que fue desarrollado cooperativamente por varias compañías, incluidas RCA y Philco.

En diciembre de 1953, la FCC aprobó por unanimidad lo que ahora se conoce como el estándar de televisión en color NTSC (más tarde definido como RS-170a). El estándar de color compatible conserva la compatibilidad hacia atrás con los televisores en blanco y negro existentes. Se agregó información de color a la imagen en blanco y negro mediante la introducción de una subportadora de color de precisamente 315/88 MHz (generalmente descrita como 3.579545 MHz o 3.58 MHz). La frecuencia precisa se eligió para que las componentes de modulación de velocidad de línea horizontal de la señal de crominancia cayeran exactamente entre las componentes de modulación de velocidad de línea horizontal de la señal de luminancia, permitiendo así que la señal de crominancia fuera filtrada de la señal de luminancia con una degradación menor de la señal de luminancia. Debido a las limitaciones de los circuitos divisores de frecuencia en el momento en que se promulgó el estándar de color, la frecuencia de la subportadora de color se construyó como frecuencia compuesta ensamblada a partir de enteros pequeños, en este caso 5 × 7 × 9 / (8 × 11) MHz. La velocidad de línea horizontal se redujo a aproximadamente 15,734 líneas por segundo (3,579545 × 2/455 MHz = 9/572 MHz) a partir de 15,750 líneas por segundo, y la velocidad de cuadros se redujo a 30 / 1.001 ≈ 29.970 cuadros por segundo (la línea horizontal tasa dividida por 525 líneas / cuadro) a partir de 30 cuadros por segundo. Estos cambios ascienden a 0.1 por ciento y fueron tolerados fácilmente por los receptores de televisión existentes.

La primera transmisión de televisión en red anunciada públicamente de un programa que utiliza el sistema NTSC de «color compatible» fue un episodio de Nuk Kukla, Fran y Ollie el 30 de agosto de 1953, aunque solo se podía ver en color en la sede de la red. El primer vistazo nacional del color NTSC se realizó el 1 de enero siguiente con la transmisión de costa a costa del Desfile del Torneo de las Rosas, visible en prototipos de receptores de colores en presentaciones especiales en todo el país. El primer color de la cámara de televisión NTSC fue el RCA TK-40, utilizado para transmisiones experimentales en 1953; una versión mejorada, el TK-40A, presentado en marzo de 1954, fue la primera cámara de televisión en color disponible comercialmente. Más tarde ese año, el TK-41 mejorado se convirtió en la cámara estándar utilizada durante gran parte de la década de 1960.

El estándar NTSC ha sido adoptado por otros países, incluyendo la mayoría de las Américas y Japón.

Con la llegada de la televisión digital, las transmisiones analógicas se están eliminando progresivamente. La mayoría de las emisoras NTSC de los EE. UU. Fueron obligadas por la FCC a cerrar sus transmisores analógicos en 2009. Las estaciones de baja potencia, las estaciones de Clase A y los traductores debieron cerrar para 2015.

Detalles técnicos

Líneas y frecuencia de actualización

La codificación de color NTSC se usa con la señal de televisión System M, que consiste en 30/1.001 (aproximadamente 29.97) fotogramas entrelazados de video por segundo. Cada cuadro está compuesto por dos campos, cada uno compuesto por 262.5 líneas de exploración, para un total de 525 líneas de exploración. 483 líneas de escaneo conforman el ráster visible. El resto (el intervalo de supresión vertical) permite la sincronización vertical y el retorno. Este intervalo de supresión se diseñó originalmente para simplemente dejar en blanco el CRT del receptor para permitir los circuitos analógicos simples y el lento retroceso vertical de los primeros receptores de TV. Sin embargo, algunas de estas líneas ahora pueden contener otros datos, como los subtítulos y el código de tiempo de intervalo vertical (VITC). En el ráster completo (sin tener en cuenta las medias líneas debido al entrelazado) se dibujan las líneas de escaneo pares (todas las demás líneas que estarían incluso contadas en la señal de video, por ejemplo {2, 4, 6, …, 524}) en el primer campo, y el número impar (cada dos líneas que serían impares si se cuenta en la señal de video, por ejemplo, {1, 3, 5, …, 525}) se dibujan en el segundo campo, para obtener un imagen libre de parpadeo en la frecuencia de refresco de campo de 60/1.001 Hz (aproximadamente 59.94 Hz). A modo de comparación, los sistemas 576i como PAL-B / G y SECAM utilizan 625 líneas (576 visibles), por lo que tienen una resolución vertical más alta, pero una resolución temporal más baja de 25 cuadros o 50 campos por segundo.

La frecuencia de actualización del campo NTSC en el sistema en blanco y negro originalmente coincidía exactamente con la frecuencia nominal de 60 Hz de la corriente alterna utilizada en los Estados Unidos. La coincidencia de la frecuencia de actualización del campo con la fuente de alimentación evitó la intermodulación (también llamada golpeteo), que produce barras de balanceo en la pantalla. La sincronización de la frecuencia de actualización con la potencia ayudó incidentalmente a las cámaras de cinescopios a grabar transmisiones de televisión en vivo temprano, ya que era muy simple sincronizar una cámara de película para capturar un fotograma de cada fotograma usando la frecuencia de corriente alterna para ajustar la velocidad del cámara síncrona con motor de CA. Cuando se agregó color al sistema, la frecuencia de actualización se desplazó ligeramente hacia abajo en un 0,1% hasta aproximadamente 59,94 Hz para eliminar los patrones de puntos estacionarios en la frecuencia de diferencia entre los portadores de sonido y color, como se explica más adelante en «Codificación de color». En el momento en que la velocidad de cuadros cambió para acomodar el color, fue casi tan fácil disparar el obturador de la cámara de la señal de video.

La cifra real de 525 líneas se eligió como consecuencia de las limitaciones de las tecnologías basadas en tubos de vacío de la actualidad. En los primeros sistemas de TV, un oscilador maestro controlado por voltaje se ejecutaba al doble de la frecuencia de línea horizontal, y esta frecuencia se dividía por el número de líneas utilizadas (en este caso 525) para dar la frecuencia de campo (60 Hz en este caso) . Esta frecuencia se comparó con la frecuencia de la línea de alimentación de 60 Hz y cualquier discrepancia se corrigió ajustando la frecuencia del oscilador maestro. Para el escaneo entrelazado, se requirió un número impar de líneas por cuadro para hacer que la distancia de retroceso vertical sea idéntica para los campos impares y pares, lo que significa que la frecuencia del oscilador maestro debe dividirse por un número impar. En ese momento, el único método práctico de división de frecuencia era el uso de una cadena de multivibradores de tubo de vacío, siendo la relación de división general el producto matemático de las relaciones de división de la cadena. Dado que todos los factores de un número impar también tienen que ser números impares, se deduce que todos los divisores de la cadena también tuvieron que dividirse por números impares, y estos tenían que ser relativamente pequeños debido a los problemas de deriva térmica con dispositivos de tubos de vacío. . La secuencia práctica más cercana a 500 que cumple estos criterios fue 3 × 5 × 5 × 7 = 525. (Por la misma razón, 625 líneas PAL-B / G y SECAM utilizan 5 × 5 × 5 × 5, el antiguo sistema británico de 405 líneas utiliza 3 × 3 × 3 × 3 × 5, el sistema francés de 819 líneas utilizado 3 × 3 × 7 × 13 etc.)

Colorimetría

La especificación NTSC original en color de 1953, que todavía forma parte del Código de Regulaciones Federales de los Estados Unidos, definió los valores colorimétricos del sistema de la siguiente manera:

| Colorimetría NTSC original (1953) | CIE 1931 x | CIE 1931 y |

|---|---|---|

| rojo primario | 0.67 | 0.33 |

| verde primario | 0.21 | 0.71 |

| azul primario | 0.14 | 0.08 |

| punto blanco (iluminador estándar CIE C) 6774 K | 0.310 | 0.316 |

Los primeros receptores de televisión en color, como el RCA CT-100, eran fieles a esta especificación (que se basaba en los estándares de cinematografía predominantes) y tenían una gama más amplia que la mayoría de los monitores actuales. Sus fósforos de baja eficiencia (especialmente en el Rojo) eran débiles y persistentes, dejando rastros después de mover objetos. A partir de finales de la década de 1950, los fósforos del tubo de imagen sacrificarían la saturación para aumentar el brillo; esta desviación del estándar tanto en el receptor como en el emisor fue la fuente de una considerable variación de color.

SMPTE C

Para garantizar una reproducción de color más uniforme, los receptores comenzaron a incorporar circuitos de corrección de color que convirtieron la señal recibida, codificada para los valores colorimétricos enumerados anteriormente, en señales codificadas para los fósforos realmente utilizados dentro del monitor. Como dicha corrección de color no se puede realizar con precisión en las señales corregidas gamma no lineales transmitidas, el ajuste solo se puede aproximar, introduciendo tanto errores de matiz como de luminancia para colores altamente saturados.

De manera similar, en la etapa de emisor, en 1968-69, la Corporación Conrac, trabajando con RCA, definió un conjunto de fósforos controlados para su uso en monitores de video en color de difusión. Esta especificación sobrevive hoy como la especificación de fósforo SMPTE «C»:

| Colorimetría SMPTE «C» | CIE 1931 x | CIE 1931 y |

|---|---|---|

| rojo primario | 0.630 | 0.340 |

| verde primario | 0.310 | 0.595 |

| azul primario | 0.155 | 0.070 |

| punto blanco (CIE iluminante D65) | 0.3127 | 0.3290 |

Al igual que con los receptores domésticos, se recomendó además que los monitores de estudio incorporen circuitos de corrección de color similares para que las emisoras transmitan imágenes codificadas para los valores colorimétricos originales de 1953, de acuerdo con los estándares de la FCC.

En 1987, el Comité de Tecnología de Televisión de la Sociedad de Ingenieros de Cine y Televisión (SMPTE), Grupo de Trabajo sobre Monitorización de Colorimetría, adoptó los fósforos SMPTE C (Conrac) para uso general en la Práctica Recomendada 145, lo que provocó que muchos fabricantes modificaran sus diseños de cámara codificar directamente para colorimetría SMPTE «C» sin corrección de color, como se aprobó en el estándar SMPTE 170M, «Señal de video compuesto analógico – NTSC para aplicaciones de estudio» (1994). Como consecuencia, el estándar de televisión digital ATSC establece que para señales 480i, se debe suponer la colorimetría SMPTE «C» a menos que se incluyan datos colorimétricos en el flujo de transporte.

El NTSC japonés nunca cambió los primarios y los puntos blancos a SMPTE «C», y continuó utilizando las primarias NTSC 1953 y el punto blanco. Los sistemas PAL y SECAM usaron la colorimetría NTSC 1953 original también hasta 1970; a diferencia de NTSC, la Unión Europea de Radiodifusión (EBU) rechazó la corrección de color en receptores y monitores de estudio ese año y pidió explícitamente que todos los equipos codifiquen directamente señales para los valores colorimétricos «EBU», mejorando aún más la fidelidad del color de esos sistemas.

Codificación de color

Para compatibilidad con televisión en blanco y negro, NTSC utiliza un sistema de codificación de luminancia-crominancia inventado en 1938 por Georges Valensi. Las tres señales de imagen en color se dividen en Luminancia (derivada matemáticamente de las tres señales de color separadas (Rojo, Verde y Azul)) que toma el lugar de la señal monocromática original y de la crominancia que transporta solo la información de color. Este proceso se aplica a cada fuente de color con su propio Colorplexer, lo que permite administrar una fuente de color compatible como si se tratara de una fuente monocromática ordinaria. Esto permite que los receptores en blanco y negro muestren señales de color NTSC simplemente ignorando la señal de crominancia. Algunos televisores en blanco y negro vendidos en los EE. UU. Después de la introducción de la transmisión en color en 1953 fueron diseñados para filtrar el cromatismo, pero los primeros sets B & W no lo hicieron y la crominancia podría verse como un «patrón de puntos» en áreas altamente coloreadas de la imagen

En NTSC, la crominancia se codifica utilizando dos señales de color conocidas como I (en fase) y Q (en cuadratura) en un proceso llamado QAM. Las dos señales modulan cada amplitud portadores de 3.58 MHz que están 90 grados desfasados entre sí y el resultado se suman, pero con los portadores mismos siendo suprimidos. El resultado se puede ver como una onda sinusoidal única con fase variable en relación con una portadora de referencia y con amplitud variable. La fase variable representa el tono de color instantáneo capturado por una cámara de TV, y la amplitud representa la saturación de color instantánea. Esta subportadora de 3,58 MHz se agrega luego a la Luminancia para formar la ‘señal de color compuesta’ que modula la portadora de señal de video igual que en la transmisión monocromática.

Para que un TV en color recupere la información de tono de la subportadora de color, debe tener una referencia de fase cero para reemplazar la portadora previamente suprimida. La señal NTSC incluye una muestra corta de esta señal de referencia, conocida como estallido de color, ubicada en el «porche trasero» de cada pulso de sincronización horizontal. La ráfaga de color consiste en un mínimo de ocho ciclos de la subportadora de color no modulada (fase fija y amplitud). El receptor de TV tiene un «oscilador local», que se sincroniza con estas ráfagas de color. La combinación de esta señal de fase de referencia derivada de la ráfaga de color con la amplitud y fase de la señal de crominancia permite la recuperación de las señales ‘I’ y ‘Q’ que cuando se combinan con la información de luminancia permiten la reconstrucción de una imagen en color en la pantalla. Se ha dicho que el televisor en color realmente es de color debido a la separación total de la parte de brillo de la imagen de la porción de color. En los televisores CRT, la señal NTSC se convierte en tres señales de color llamadas Rojo, Verde y Azul, cada una de las cuales controla ese cañón de electrones de color. Los televisores con circuitos digitales usan técnicas de muestreo para procesar las señales, pero el resultado final es el mismo. Para los conjuntos analógicos y digitales que procesan una señal NTSC analógica, las tres señales de color originales (Rojo, Verde y Azul) se transmiten usando tres señales discretas (Luminancia, I y Q) y luego se recuperan como tres colores separados y se combinan como una imagen en color .

Cuando un transmisor transmite una señal NTSC, modula en amplitud una portadora de radiofrecuencia con la señal NTSC que se acaba de describir, mientras que modula en frecuencia una portadora 4.5 MHz superior con la señal de audio. Si ocurre una distorsión no lineal en la señal de emisión, la portadora de color de 3.579545 MHz puede vencer con el portador de sonido para producir un patrón de puntos en la pantalla. Para hacer que el patrón resultante sea menos notorio, los diseñadores ajustaron la velocidad original de escaneo de 15,750 Hz por un factor de 1.001 (0.1%) para coincidir con la frecuencia del portador de audio dividido por el factor 286, lo que resulta en una frecuencia de campo de aproximadamente 59.94 Hz. Este ajuste asegura que las sumas y diferencias del portador de sonido y la subportadora de color y sus múltiplos (es decir, los productos de intermodulación de las dos portadoras) no son múltiplos exactos de la velocidad de cuadro, que es la condición necesaria para que los puntos permanezcan estacionarios en la pantalla, haciéndolos más perceptibles.

La tasa de 59.94 se deriva de los siguientes cálculos. Los diseñadores optaron por hacer que la frecuencia de la subportadora de crominancia sea n + 0.5 múltiplo de la frecuencia de línea para minimizar la interferencia entre la señal de luminancia y la señal de crominancia. (Otra forma de decir esto es que la frecuencia de la subportadora de color es un múltiplo impar de la mitad de la frecuencia de línea). Luego optaron por hacer que la frecuencia de la subportadora de audio sea un múltiplo entero de la frecuencia de línea para minimizar la interferencia visible (intermodulación) entre el audio señal y la señal de crominancia. El estándar blanco y negro original, con su frecuencia de línea de 15.750 Hz y su subportadora de audio de 4.5 MHz, no cumple con estos requisitos, por lo que los diseñadores tuvieron que elevar la frecuencia de la subportadora de audio o disminuir la frecuencia de línea. Elevar la frecuencia de la subportadora de audio evitaría que los receptores existentes (blanco y negro) sintonicen correctamente la señal de audio. La reducción de la frecuencia de línea es comparativamente inocua, porque la información de sincronización horizontal y vertical en la señal NTSC permite que un receptor tolere una cantidad sustancial de variación en la frecuencia de línea. Entonces los ingenieros eligieron la frecuencia de línea que se cambiará para el estándar de color. En el estándar en blanco y negro, la relación entre la frecuencia de la subportadora de audio y la frecuencia de línea es de 4,5 MHz / 15,750 Hz = 285,71. En el estándar de color, este se redondea al número entero 286, lo que significa que la tasa de línea del estándar de color es 4.5 MHz / 286 ≈ 15,734 Hz. Manteniendo el mismo número de líneas de escaneo por campo (y marco), la tasa de línea más baja debe producir una tasa de campo más baja. Dividir 4500000/286 líneas por segundo por 262.5 líneas por campo da aproximadamente 59.94 campos por segundo.

Método de modulación de transmisión

Un canal de televisión NTSC transmitido ocupa un ancho de banda total de 6 MHz. La señal de video real, que está modulada en amplitud, se transmite entre 500 kHz y 5,45 MHz por encima del límite inferior del canal. La portadora de video es 1.25 MHz por encima del límite inferior del canal. Al igual que la mayoría de las señales de AM, el portador de video genera dos bandas laterales, una sobre la portadora y la otra debajo. Las bandas laterales son cada una de 4.2 MHz de ancho. Toda la banda lateral superior se transmite, pero solo se transmite 1.25 MHz de la banda lateral inferior, conocida como banda lateral vestigial. La subportadora de color, como se indicó anteriormente, está a 3.579545 MHz por encima de la portadora de video, y está modulada en amplitud en cuadratura con una portadora suprimida. La señal de audio está modulada en frecuencia, al igual que las señales de audio emitidas por estaciones de radio FM en la banda de 88-108 MHz, pero con una desviación de frecuencia máxima de 25 kHz, a diferencia de 75 kHz como se usa en la banda de FM, produciendo televisión analógica las señales de audio suenan más silenciosas que las señales de radio FM que se reciben en un receptor de banda ancha. La portadora de audio principal está 4,5 MHz por encima del portador de video, por lo que es 250 kHz por debajo de la parte superior del canal. A veces, un canal puede contener una señal MTS, que ofrece más de una señal de audio al agregar una o dos subportadoras en la señal de audio, cada una sincronizada a un múltiplo de la frecuencia de línea. Este es normalmente el caso cuando se utilizan señales de audio estéreo y / o segundas señales de programas de audio. Las mismas extensiones se utilizan en ATSC, donde la portadora digital ATSC se transmite a 0,31 MHz por encima del límite inferior del canal.

«Configuración» es una compensación de voltaje de 54 mV (7.5 IRE) entre los niveles «negro» y «blanco». Es exclusivo de NTSC. CVBS significa Color, Video, Blanking y Sync.

Conversión de tasa de cuadros

Hay una gran diferencia en la velocidad de fotogramas entre películas, que se ejecuta a 24.0 fotogramas por segundo, y el estándar NTSC, que se ejecuta en aproximadamente 29.97 (10 MHz × 63/88/455/525) fotogramas por segundo. En regiones que usan estándares de televisión y video de 25 fps, esta diferencia se puede superar acelerando.

Para estándares de 30 fps, se usa un proceso llamado «pulldown 3: 2». Se transmite un cuadro de película para tres campos de video (con una duración de 1½ cuadros de video), y el siguiente fotograma se transmite para dos campos de video (con una duración de 1 fotograma de video). De este modo, se transmiten dos fotogramas de película en cinco campos de video, para un promedio de 2½ campos de video por fotograma de película. La velocidad de cuadros promedio es por lo tanto 60 ÷ 2.5 = 24 fotogramas por segundo, por lo que la velocidad promedio de la película es nominalmente exactamente lo que debería ser. (En realidad, en el transcurso de una hora de tiempo real, se muestran 215,827.2 campos de video, que representan 86,330.88 cuadros de película, mientras que en una hora de proyección real de película de 24 fps, se muestran exactamente 86,400 cuadros: así, 29.97-fps NTSC la transmisión de películas de 24 fps funciona al 99,92% de la velocidad normal de la película.) El encuadre en la reproducción puede mostrar un cuadro de video con campos de dos fotogramas diferentes, por lo que cualquier diferencia entre los fotogramas aparecerá como un rápido retroceso adelante parpadeo. También puede haber notable inestabilidad / «tartamudeo» durante las cámaras de cámara lenta (temblor de telecine).

Para evitar el pulldown 3: 2, la captura de película específicamente para televisión NTSC a menudo se toma a 30 fotogramas por segundo.

Para mostrar material de 25 fps (como series de televisión europeas y algunas películas europeas) en equipos NTSC, cada quinto fotograma se duplica y luego el flujo resultante se entrelaza.

La captura de película para televisión NTSC a 24 fotogramas por segundo se ha acelerado tradicionalmente en 1/24 (hasta aproximadamente el 104.17% de la velocidad normal) para la transmisión en regiones que usan estándares de televisión de 25 fps. Este aumento en la velocidad de la imagen ha sido acompañado tradicionalmente por un aumento similar en el tono y el tempo del audio. Más recientemente, la combinación de fotogramas se ha utilizado para convertir videos de 24 FPS a 25 FPS sin alterar su velocidad.

La película filmada para televisión en regiones que usan estándares de televisión de 25 fps se puede manejar de dos maneras:

La película se puede filmar a 24 fotogramas por segundo. En este caso, cuando se transmite en su región nativa, la película puede acelerarse a 25 fps de acuerdo con la técnica analógica descrita anteriormente, o mantenerse a 24 fps mediante la técnica digital descrita anteriormente. Cuando la misma película se transmite en regiones que usan un estándar de televisión nominal de 30 fps, no hay cambios notables en la velocidad, el tempo y el tono.

La película se puede tomar a 25 fotogramas por segundo. En este caso, cuando se transmite en su región nativa, la película se muestra a su velocidad normal, sin alteración de la banda sonora que la acompaña. Cuando se muestra la misma película en regiones que usan un estándar de televisión nominal de 30 fps, cada quinto fotograma está duplicado, y todavía no hay cambios notables en la velocidad, el tempo y el tono.

Debido a que ambas velocidades de película se han utilizado en regiones de 25 fps, los espectadores pueden enfrentar confusión sobre la velocidad real de video y audio, y el tono de voces, efectos de sonido y actuaciones musicales en películas de televisión de esas regiones. Por ejemplo, pueden preguntarse si la serie Jeremy Brett de películas de televisión Sherlock Holmes, realizada en la década de 1980 y principios de la década de 1990, se filmó a 24 fps y luego se transmitió a una velocidad artificialmente rápida en regiones de 25 fps, o si fue filmada en 25 fps nativo y luego ralentizado a 24 fps para la exposición NTSC.

Estas discrepancias existen no solo en las transmisiones de televisión por aire y por cable, sino también en el mercado de videos domésticos, tanto en cintas como en discos, incluidos discos láser y DVD.

En la televisión y el video digital, que están reemplazando a sus predecesores analógicos, los estándares únicos que pueden acomodar un rango más amplio de velocidades de cuadro aún muestran los límites de los estándares regionales analógicos. El estándar ATSC, por ejemplo, permite tasas de cuadros de 23.976, 24, 29.97, 30, 59.94 y 60 cuadros por segundo, pero no 25 y 50.

Modulación para transmisión analógica por satélite

Debido a que la potencia del satélite es muy limitada, la transmisión de video analógico a través de los satélites difiere de la transmisión de televisión terrestre. AM es un método de modulación lineal, por lo que una determinada relación señal / ruido (SNR) demodulada requiere una RF SNR igualmente alta. La SNR del video con calidad de estudio es superior a 50 dB, por lo que AM requeriría potencias prohibitivamente altas y / o antenas grandes.

Wideband FM se utiliza en su lugar para intercambiar ancho de banda de RF por una potencia reducida. Aumentar el ancho de banda del canal de 6 a 36 MHz permite una RF SNR de solo 10 dB o menos. El ancho de banda de ruido más amplio reduce este ahorro de energía de 40 dB en 36 MHz / 6 MHz = 8 dB para una reducción neta sustancial de 32 dB.

El sonido se encuentra en una subportadora de FM como en la transmisión terrestre, pero las frecuencias superiores a 4,5 MHz se utilizan para reducir la interferencia aural / visual. 6.8, 5.8 y 6.2 MHz son comúnmente utilizados. Stereo puede ser múltiplex, discreto o de matriz y las señales de audio y datos no relacionadas se pueden colocar en subportadoras adicionales.

Se agrega una forma de onda triangular de dispersión de energía de 60 Hz a la señal de banda base compuesta (video más audio y subportadoras de datos) antes de la modulación. Esto limita la densidad espectral de potencia del enlace descendente del satélite en caso de que se pierda la señal de video. De lo contrario, el satélite podría transmitir toda su potencia en una sola frecuencia, interfiriendo con enlaces de microondas terrestres en la misma banda de frecuencia.

En el modo de mitad de transpondedor, la desviación de frecuencia de la señal de banda de base compuesta se reduce a 18 MHz para permitir otra señal en la otra mitad del transpondedor de 36 MHz. Esto reduce un poco el beneficio de FM, y las SNR recuperadas se reducen aún más porque la potencia de señal combinada debe ser «retrocedida» para evitar la distorsión de intermodulación en el transpondedor del satélite. Una sola señal FM es de amplitud constante, por lo que puede saturar un transpondedor sin distorsión.

Orden de campo

Un «cuadro» NTSC consiste en un campo «par» seguido de un campo «impar». En lo que respecta a la recepción de una señal analógica, esto es puramente una cuestión de convención y no hace ninguna diferencia. Es más bien como las líneas quebradas que corren en el medio de una carretera, no importa si se trata de un par línea / espacio o un par de espacio / línea; el efecto para un conductor es exactamente el mismo.

La introducción de los formatos de televisión digital ha cambiado algo las cosas. La mayoría de los formatos de TV digital almacenan y transmiten campos en pares como un solo marco digital. Los formatos digitales que coinciden con la tasa de campo NTSC, incluido el popular formato de DVD, graban video con el campo par primero en el marco digital, mientras que los formatos que coinciden con la frecuencia de campo del sistema de 625 líneas a menudo primero graban video con fotograma impar. Esto significa que cuando se reproducen muchos formatos digitales no basados en NTSC es necesario invertir el orden de los campos, de lo contrario se produce un efecto de «peinado» estremecedor inaceptable en los objetos en movimiento como se muestran adelante en un campo y luego vuelven al siguiente.

Esto también se ha convertido en un peligro donde el video progresivo no NTSC se transcodifica a entrelazado y viceversa. Los sistemas que recuperan cuadros progresivos o transcodifican video deben garantizar que se obedezca el «Orden de campo»; de lo contrario, el marco recuperado consistirá en un campo de un cuadro y un campo de un cuadro adyacente, lo que producirá artefactos de entrelazado «en peine». Esto a menudo se puede observar en las utilidades de reproducción de video basadas en PC si se realiza una elección inapropiada del algoritmo de desentrelazado.

Durante las décadas de transmisiones de NTSC de alta potencia en los Estados Unidos, el cambio entre las vistas de dos cámaras se llevó a cabo de acuerdo con dos estándares, la elección entre los dos se realizó por geografía, Este versus Oeste. En una región, el cambio se hizo entre el campo impar que terminó un cuadro y el campo par que comenzó el siguiente cuadro; en el otro, el cambio se realizó después de un campo par y antes de un campo impar. Así, por ejemplo, una grabación VHS doméstica hecha de un noticiario de televisión local en el Este, cuando está en pausa, solo mostraría la vista desde una cámara (a menos que se pretenda disolver u otra toma multicámara), mientras que la reproducción VHS de una situación comedia grabado y editado en Los Ángeles y luego transmitido a nivel nacional podría detenerse en el momento de un cambio entre cámaras con la mitad de las líneas que representan el plano saliente y la otra mitad que representa el plano entrante.